AWS разрабатывает суперкомпьютер для ИИ

Иску́сственный интелле́кт (ИИ; англ. artificial intelligence, AI) — свойство искусственных интеллектуальных систем выполнять творческие функции, которые традиционно считаются прерогативой человека (не следует путать с искусственным сознанием); наука и технология создания интеллектуальных машин, особенно интеллектуальных компьютерных программ.

Искусственный интеллект связан со сходной задачей использования компьютеров для понимания человеческого интеллекта, но не обязательно ограничивается биологически правдоподобными методами.

Существующие на сегодня интеллектуальные системы имеют довольно узкие области применения. Википедия

Иску́сственный интелле́кт (ИИ; англ. artificial intelligence, AI) — свойство искусственных интеллектуальных систем выполнять творческие функции, которые традиционно считаются прерогативой человека (не следует путать с искусственным сознанием); наука и технология создания интеллектуальных машин, особенно интеллектуальных компьютерных программ.

Искусственный интеллект связан со сходной задачей использования компьютеров для понимания человеческого интеллекта, но не обязательно ограничивается биологически правдоподобными методами.

Существующие на сегодня интеллектуальные системы имеют довольно узкие области применения. Википедия

Читайте также:Глава PlayStation: ИИ не заменит созданный вручную контентРоль человека в создании игр — мнение гендиректора PlayStationСША усиливают санкции против КитаяИнвестиции в стартап Tenstorrent: борьба с NvidiaКитай представил чип «Global Scheduling Ethernet» для предоставления сетевых решений для ИИ

NVIDIA Corporation (NASDAQ: NVDA) — американская компания, один из крупнейших разработчиков графических ускорителей и процессоров, а также наборов системной логики. На рынке продукция компании известна под такими торговыми марками как GeForce, nForce, Quadro, Tesla, ION и Tegra. Компания была основана в 1993 году. По состоянию на август 2006 года в корпорации насчитывалось более 8 тысяч сотрудников, работающих в 40 офисах по всему миру. Википедия

Читайте также:Nvidia привлекает кадры через слияния и поглощенияПродажи дискретных графических процессоров падают, в то время как Nvidia продолжает доминироватьИнвестиции в стартап Tenstorrent: борьба с NvidiaИнсайдер показал изображение графического процессора Nvidia RTX 5090D для КитаяСообщается, что графический процессор Nvidia RTX 5090 GB202 имеет размер кристалла 744 мм²

Amazon.com, Inc. (произносится э́мазон ком инко́рпоре́йтед, в русском языке произносится амазо́н) — американская компания, крупнейшая в мире по обороту среди продающих товары и услуги через Интернет и один из первых интернет-сервисов, ориентированных на продажу реальных товаров массового спроса. Штаб-квартира расположена в Сиэтле (штат Вашингтон). Википедия

Amazon.com, Inc. (произносится э́мазон ком инко́рпоре́йтед, в русском языке произносится амазо́н) — американская компания, крупнейшая в мире по обороту среди продающих товары и услуги через Интернет и один из первых интернет-сервисов, ориентированных на продажу реальных товаров массового спроса. Штаб-квартира расположена в Сиэтле (штат Вашингтон). Википедия

Читайте также:Мэттью Риз и Джон Красински снимутся в новом сериале Amazon «Тихая река»Исполнительный продюсер World of Warcraft о новом фильмеAmazon представил кадры из новых эпизодов «Секретного уровня»Cериал Like A Dragon: Yakuza изначально был ориентирован на американского зрителяВ сериале Amazon Tomb Raider может появиться звезда «Игры престолов» в роли Лары Крофт

Высокопропускная память (англ. high bandwidth memory, HBM) — высокопроизводительный интерфейс ОЗУ для DRAM с многослойной компоновкой кристаллов в микросборке от компаний AMD и Hynix, применяемая в высокопроизводительных видеокартах и сетевых устройствах; основной конкурент технологии Hybrid Memory Cube от Micron. AMD Fiji и AMD Arctic Islands являются первыми видеопроцессорами, использующими НВМ.

Была стандартизирована JEDEC в октябре 2013 года как JESD235, HBM2 стандартизована в январе 2016 года под кодом JESD235a. На середину 2016 года сообщалось о работах над HBM3 и более дешёвым вариантом HBM, иногда называемом HBM2e. Википедия

Высокопропускная память (англ. high bandwidth memory, HBM) — высокопроизводительный интерфейс ОЗУ для DRAM с многослойной компоновкой кристаллов в микросборке от компаний AMD и Hynix, применяемая в высокопроизводительных видеокартах и сетевых устройствах; основной конкурент технологии Hybrid Memory Cube от Micron. AMD Fiji и AMD Arctic Islands являются первыми видеопроцессорами, использующими НВМ.

Была стандартизирована JEDEC в октябре 2013 года как JESD235, HBM2 стандартизована в январе 2016 года под кодом JESD235a. На середину 2016 года сообщалось о работах над HBM3 и более дешёвым вариантом HBM, иногда называемом HBM2e. Википедия

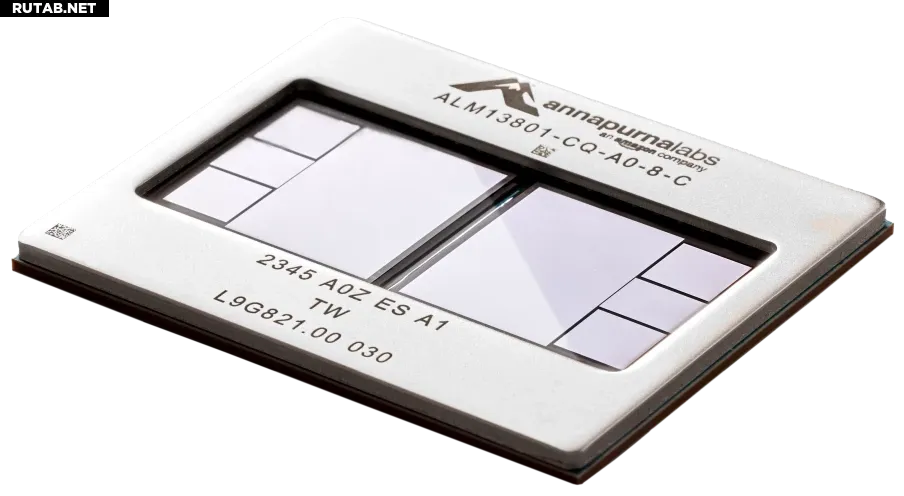

Изображение: AWS

На конференции re:Invent 2024 компания AWS сделала три объявления, связанных с Trainium2:

Во-первых, теперь общедоступны инстансы Amazon Elastic Compute Cloud (Amazon EC2) EC2 Trn2 на базе AWS Trainium2. Эти инстансы оснащены 16 процессорами Trainium2, соединенными с помощью соединения NeuronLink, которые обеспечивают производительность до 20,8 FP8 PetaFLOPS и 1,5 ТБ памяти HBM3 с пиковой пропускной способностью 46 ТБ/с. Это по сути означает, что каждый Trainium2 обеспечивает производительность до 1,3 FP8 для ИИ, что вдвое выше показателя, обсуждавшегося в прошлом году. Возможно, AWS нашла способ оптимизировать производительность процессора, или, может быть, она ранее приводила цифры FP16, но 1,3 петафлопса производительности FP8 сопоставимы с производительностью FP8 Nvidia H100 в 1,98 FP8 (без разреженности).

Во-вторых, AWS строит EC2 Trn2 UltraServers с 64 взаимосвязанными чипами Trainium2, которые предлагают 83,2 FP8 PetaFLOPS производительности, а также 6 ТБ памяти HBM3 с пиковой пропускной способностью 185 ТБ/с. Машины используют сетевое соединение Elastic Fabric Adapter (EFA) 12,8 Тбит/с для взаимодействия.

Anthropic — американский стартап и общественно-полезная корпорация в сфере искусственного интеллекта (ИИ), основанная бывшими сотрудниками OpenAI. Anthropic специализируется на разработке общих систем искусственного интеллекта и языковых моделей, придерживаясь корпоративной этики ответственного использования ИИ. С конца 2022 года Google инвестировал в компанию почти 400 миллионов долларов, а Anthropic объявила о формальном партнерстве с Google Cloud. Википедия

Читайте также:Anthropic и Palantir объединяются для внедрения моделей ИИ Claude в AWSAnthropic создаёт новую модель ИИ Claude 3.5 SonnetAmazon инвестирует до $4 млрд в ИИ-стартап Anthropic

AWS не раскрывает, сколько процессоров Trainium2 будет использовать EC2 UltraCluster, но если предположить, что максимальная масштабируемость экземпляров Trn2 составляет 100 000 процессоров, то это говорит о системе с производительностью около 130 FP8 ExaFLOPS, что довольно много и эквивалентно примерно 32 768 процессорам Nvidia H100.

«Trainium2 специально создан для поддержки самых крупных и самых современных генеративных рабочих нагрузок ИИ, как для обучения, так и для вывода, а также для обеспечения наилучшего соотношения цены и производительности на AWS», — сказал Дэвид Браун, вице-президент по вычислениям и сетевым технологиям в AWS. «Поскольку модели приближаются к триллионам параметров, мы понимаем, что клиентам также нужен новый подход к обучению и запуску этих огромных рабочих нагрузок. Новые Trn2 UltraServers предлагают самую быструю производительность обучения и вывода на AWS и помогают организациям всех размеров обучать и развертывать самые большие в мире модели быстрее и с меньшими затратами».

Кроме того, AWS представила процессор Trainium3 следующего поколения, который будет производиться по 3-нм техпроцессу TSMC, обеспечивать более высокую производительность, чем его предшественники, и станет доступен клиентам AWS в 2025 году. Amazon ожидает, что Trn3 UltraServers будут в четыре раза быстрее Trn2 UltraServers, достигнув 332,9 FP8 PetaFLOPS на машину и 5,2 FP8 PetaFLOPS на процессор, если количество процессоров останется на уровне 64.

Источник: Tomshardware.com

0 комментариев