Micron внедряет инновации от центра обработки данных до периферии с NVIDIA

Иску́сственный интелле́кт (ИИ; англ. artificial intelligence, AI) — свойство искусственных интеллектуальных систем выполнять творческие функции, которые традиционно считаются прерогативой человека (не следует путать с искусственным сознанием); наука и технология создания интеллектуальных машин, особенно интеллектуальных компьютерных программ.

Искусственный интеллект связан со сходной задачей использования компьютеров для понимания человеческого интеллекта, но не обязательно ограничивается биологически правдоподобными методами.

Существующие на сегодня интеллектуальные системы имеют довольно узкие области применения. Википедия

Иску́сственный интелле́кт (ИИ; англ. artificial intelligence, AI) — свойство искусственных интеллектуальных систем выполнять творческие функции, которые традиционно считаются прерогативой человека (не следует путать с искусственным сознанием); наука и технология создания интеллектуальных машин, особенно интеллектуальных компьютерных программ.

Искусственный интеллект связан со сходной задачей использования компьютеров для понимания человеческого интеллекта, но не обязательно ограничивается биологически правдоподобными методами.

Существующие на сегодня интеллектуальные системы имеют довольно узкие области применения. Википедия

Читайте также:Solidigm создаёт ИИ-накопители с жидкостным охлаждениемKIOXIA расширяет возможности ИИ на NVIDIA GTC 2025Apple A20 SoC: улучшен ИИ благодаря технологии TSMC N3PНоутбуки MSI GeForce RTX 50 готовы к высокопроизводительным играм и локальным приложениям ИИAMD заявляет, что ее процессор Ryzen AI Max+ 395 в 12,2 раза быстрее Lunar Lake в задачах ИИ

Micron Technology — американская транснациональная корпорация, известная своей полупроводниковой продукцией, основную часть которой составляют чипы памяти DRAM и NAND, флеш-память, SSD-накопители, а также датчики КМОП. Продукция для потребительского рынка продается под торговой маркой Crucial Technology и малая часть продукции выходит под маркой Micron. Википедия

Читайте также:Micron представил самый быстрый твердотельный PCIe 6.0 накопительMicron назначает Марка Лю и Кристи Саймонса в Совет директоровMicron представляет память DDR5-9200: технологический процесс 1γ с EUVMicron объявляет о поставке 1γ (1-гамма) DRAM: первого узла EUV-памяти компанииMicron представляет свой первый высокопроизводительный клиентский SSD PCIe Gen5 NVMe

Читайте также:Процессор AMD Instinct MI325X улыбается в камеру: 256 ГБ памяти HBM3ESK hynix на выставке CES: HBM3E, SSD и LPCAMM23NVIDIA GB300 «Blackwell Ultra» будет оснащена 288 ГБ памяти HBM3E, TDP - 1400 ВтSK hynix представляет первый в мире 16-High HBM3E на SK AI Summit 2024AMD выпустила ускоритель Instinct MI325X для ИИ

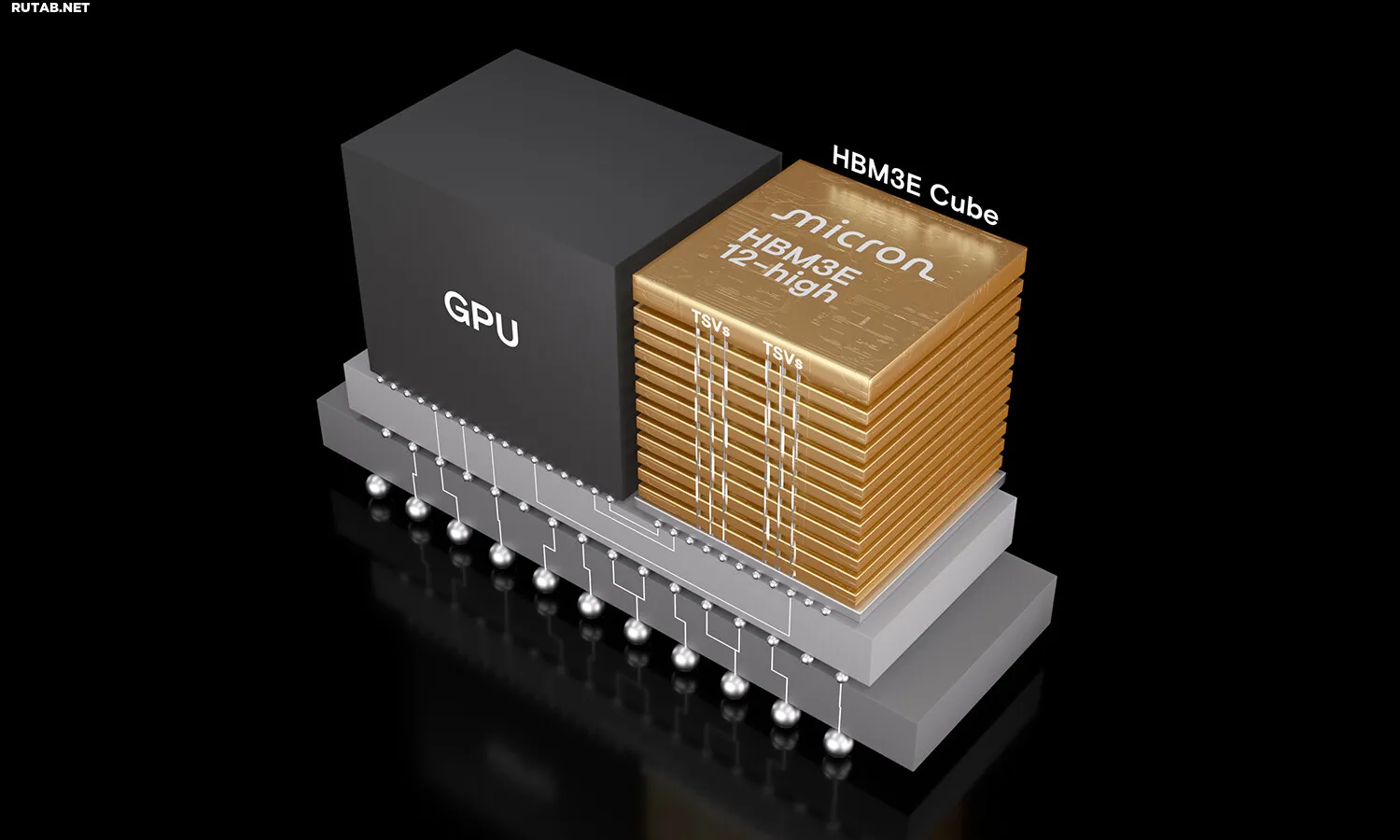

SOCAMM от Micron, модульное решение памяти LPDDR5X, было разработано в сотрудничестве с NVIDIA для поддержки NVIDIA GB300 Grace Blackwell Ultra Superchip. Micron HBM3E 12H 36 GB также разработан для платформ NVIDIA HGX B300 NVL16 и GB300 NVL72, в то время как HBM3E 8H 24 GB доступен для платформ NVIDIA HGX B200 и GB200 NVL72. Развертывание продуктов Micron HBM3E в системах NVIDIA Hopper и NVIDIA Blackwell подчеркивает важную роль Micron в ускорении рабочих нагрузок ИИ.

Думайте об ИИ, думайте о памяти, думайте о Micron

На GTC 2025 Micron представит свой полный портфель памяти и хранилищ для ИИ, чтобы подпитывать ИИ от центра обработки данных до периферии, подчеркивая глубокую согласованность между Micron и ее партнерами по экосистеме. Широкий портфель Micron включает HBM3E 8H 24 ГБ и HBM3E 12H 36 ГБ, LPDDR5X SOCAMM, GDDR7 и высокопроизводительные DDR5 RDIMM и MRDIMM. Кроме того, Micron предлагает ведущий в отрасли портфель SSD для центров обработки данных, а также автомобильные и промышленные продукты, такие как UFS4.1, NVMe SSD и LPDDR5X, все из которых подходят для периферийных вычислительных приложений.

«ИИ меняет парадигму в вычислениях, а память находится в центре этой эволюции. Вклад Micron в платформу NVIDIA Grace Blackwell обеспечивает значительные преимущества в производительности и энергосбережении для приложений обучения и вывода ИИ», — сказал Радж Нарасимхан, старший вице-президент и генеральный менеджер подразделения вычислений и сетей Micron. «Решения памяти HBM и LP помогают раскрыть улучшенные вычислительные возможности графических процессоров».

SOCAMM: новый стандарт производительности и эффективности памяти ИИ

Решение SOCAMM от Micron теперь находится в серийном производстве. Модульное решение SOCAMM обеспечивает ускоренную обработку данных, превосходную производительность, непревзойденную энергоэффективность и улучшенную ремонтопригодность для предоставления памяти большой емкости для растущих требований к рабочей нагрузке ИИ.

Micron SOCAMM — это самое быстрое, самое маленькое, самое энергосберегающее и самое емкое модульное решение памяти в мире, разработанное для удовлетворения потребностей серверов ИИ и приложений с интенсивным использованием данных. Это новое решение SOCAMM позволяет центрам обработки данных получить ту же вычислительную мощность с лучшей пропускной способностью, улучшенным энергопотреблением и возможностями масштабирования для обеспечения гибкости инфраструктуры.

- Самый быстрый: SOCAMM обеспечивает более чем в 2,5 раза большую пропускную способность при той же емкости по сравнению с RDIMM, что позволяет быстрее получать доступ к большим наборам обучающих данных и более сложным моделям, а также увеличивает пропускную способность для рабочих нагрузок вывода.2

- Самый маленький: инновационный форм-фактор SOCAMM размером 14x90 мм занимает треть размера стандартного форм-фактора RDIMM, что позволяет создавать компактные и эффективные серверы.

- Самая низкая мощность: используя память LPDDR5X, продукты SOCAMM потребляют на треть меньше энергии по сравнению со стандартными модулями DDR5 RDIMM, что влияет на кривую производительности энергопотребления в архитектурах ИИ.

- Самая высокая емкость: решения SOCAMM используют четыре размещения 16-кристальных стеков памяти LPDDR5X для обеспечения модуля памяти емкостью 128 ГБ, предлагая решение памяти LPDDR5X самой высокой емкости, что необходимо для продвижения к более быстрому обучению моделей ИИ и увеличения числа одновременных пользователей для рабочих нагрузок вывода.

- Оптимизированная масштабируемость и удобство обслуживания: модульная конструкция SOCAMM и инновационная технология стекирования улучшают удобство обслуживания и помогают проектировать серверы с жидкостным охлаждением. Улучшенная функция исправления ошибок в LPDDR5X от Micron с тестовыми потоками, ориентированными на центр обработки данных, обеспечивает оптимизированное решение памяти, разработанное для центра обработки данных.

Ведущие в отрасли решения HBM

Компания Micron сохраняет свое конкурентное лидерство в отрасли искусственного интеллекта, предлагая на 50% большую емкость по сравнению с HBM3E 8H 24 ГБ в том же форм-факторе куба.5 Кроме того, HBM3E 12H 36 ГБ обеспечивает на 20% меньшее энергопотребление по сравнению с предложением конкурентов HBM3E 8H 24 ГБ, при этом обеспечивая на 50% большую емкость памяти.

Продолжая обеспечивать исключительные показатели мощности и производительности, Micron стремится сохранить свой технологический импульс в качестве ведущего поставщика решений памяти для ИИ посредством запуска HBM4. Ожидается, что решение HBM4 от Micron повысит производительность более чем на 50% по сравнению с HBM3E.

Комплексные решения для памяти и хранения данных, разработанные для ИИ от центра обработки данных до периферии

Micron также имеет проверенный портфель продуктов для хранения данных, разработанных для удовлетворения растущих потребностей рабочих нагрузок ИИ. Развитие технологий хранения данных в производительности и энергоэффективности со скоростью света требует тесного сотрудничества с партнерами по экосистеме для обеспечения взаимодействия и бесперебойного взаимодействия с клиентами. Micron поставляет оптимизированные твердотельные накопители для рабочих нагрузок ИИ, таких как: вывод, обучение, подготовка данных, аналитика и озера данных. Micron представит на GTC следующие решения для хранения данных:

- Высокопроизводительные твердотельные накопители Micron 9550 NVMe и Micron 7450 NVMe включены в список рекомендуемых поставщиков GB200 NVL72.

- Твердотельный накопитель PCIe Gen 6 от Micron продемонстрировал пропускную способность более 27 ГБ/с в ходе успешного тестирования на совместимость с ведущими поставщиками коммутаторов и ретаймеров PCIe, что подтолкнуло отрасль к переходу на это новое поколение флэш-памяти.

- Хранение большего количества данных в меньшем пространстве имеет решающее значение для максимального использования центров обработки данных ИИ. Micron 61,44 ТБ 6550 ION NVMe SSD — это диск, который выбирают для передовых решений по хранению данных кластера ИИ exascale, обеспечивая более 44 петабайт хранилища на стойку, 14 ГБ/с и 2 миллиона IOPS на диск в 20-ваттной зоне.

По мере того, как ИИ и генеративный ИИ расширяются и интегрируются на устройствах на периферии, Micron тесно сотрудничает с ключевыми партнерами по экосистеме, чтобы предоставлять инновационные решения для ИИ для автомобильной, промышленной и потребительской отраслей. Помимо высоких требований к производительности, эти приложения требуют повышенных требований к качеству, надежности и долговечности для моделей использования приложений.

- Одним из примеров такого типа экосистемного сотрудничества является интеграция Micron LPDDR5X на платформе NVIDIA DRIVE AGX Orin. Это комбинированное решение обеспечивает повышенную производительность обработки и пропускную способность, а также снижает энергопотребление.

- Благодаря использованию узла DRAM 1β (1-beta) компании Micron память LPDDR5X соответствует требованиям автомобильной и промышленной отрасли и обеспечивает более высокую скорость до 9,6 Гбит/с и увеличенную емкость с 32 Гбит/с до 128 Гбит/с для поддержки более высокой пропускной способности.

- Кроме того, автомобильная продукция Micron LPDDR5X поддерживает рабочие среды от -40 до 125 градусов Цельсия, обеспечивая широкий температурный диапазон, соответствующий качеству и стандартам автомобильной промышленности.

Источник: Techpowerup.com

0 комментариев