Nvidia открывает исходный код технологии Audio2Face для создания анимированных персонажей

Компания Nvidia объявила, что её технология анимации лиц Audio2Face станет открытой. Теоретически это должно значительно упростить для широкого круга разработчиков игр создание ИИ-персонажей с убедительной мимикой, в том числе во время разговоров с игроками в реальном времени.

Если вспомнить слова самой Nvidia, то «используя большие языковые и речевые модели, генеративный ИИ создаёт интеллектуальные 3D-аватары, которые могут вести естественные беседы с пользователями — от видеоигр до службы поддержки. Чтобы сделать этих персонажей по-настоящему реалистичными, им нужны человеческие выражения».

Здесь на помощь приходит Audio2Face от Nvidia. Компания заявляет, что «Audio2Face ускоряет создание реалистичных цифровых персонажей, предоставляя анимацию лица и синхронизацию губ в реальном времени на основе генеративного ИИ».

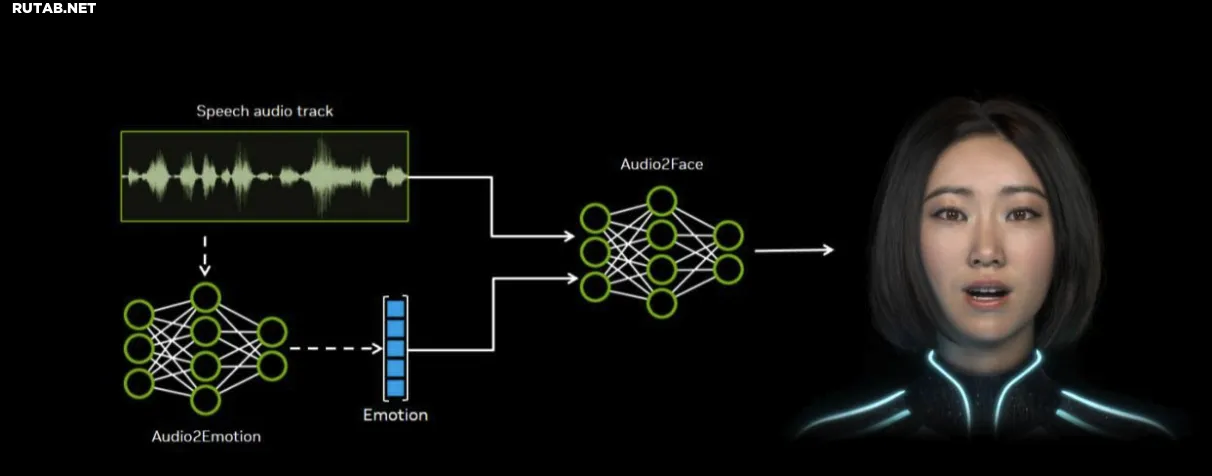

«Audio2Face использует ИИ для генерации реалистичной лицевой анимации из аудиовхода. Он работает путём анализа акустических особенностей, таких как фонемы и интонация, для создания потока данных анимации, которые затем сопоставляются с лицевыми позами персонажа. Эти данные могут быть отрендерены офлайн для заранее написанного контента или передаваться в реальном времени для динамичных персонажей, управляемых ИИ, обеспечивая точную синхронизацию губ и эмоциональные выражения».

Короче говоря, открывая исходный код Audio2Face, Nvidia надеется «ускорить внедрение аватаров с искусственным интеллектом в играх и 3D-приложениях».

Audio2Face является частью более широкой платформы Nvidia ACE, которая посвящена созданию более убедительных цифровых аватаров людей. Наш коллега Джейкоб Р. познакомился с Audio2Face в прошлом году и остался под впечатлением. Подпитываемый ответами, сгенерированными большой языковой моделью, Джейкоб нашёл конечный результат «пугающе хорошим».

Единственным действительно очевидным признаком того, что вы имеете дело с ранней экспериментальной системой, является небольшая задержка в ответах, которая создавала «неловкие паузы» в разговоре.

Что касается того, что выпускается в виде открытого исходного кода, то речь идёт о Audio2Face SDK, аудиоплагинах для ввода голосовых потоков, фреймворках для обучения, примерах обучающих данных, библиотеке моделей лиц и специальном плагине для Unreal Engine 5. В открытый релиз также включены модели Audio2Emotion, которые могут «выводить» эмоциональное состояние из аудио в реальном времени.

Nvidia сообщает, что среди игровых разработчиков, которые уже используют Audio2Face, — Codemasters, GSC Game World, NetEase, Perfect World Games, а среди независимых поставщиков программного обеспечения — Convai, Inworld AI, Reallusion, Streamlabs и UneeQ.

Разумеется, загвоздка всего этого заключается в том, что более широкая платформа ACE от Nvidia, неизбежно, по крайней мере в некоторой степени, привязана к GPU Nvidia, хотя, как мы понимаем, нет никаких очевидных причин, по которым функции ACE не должны работать на GPU других производителей.

Но, как и в случае со многими захватывающими технологиями от Nvidia, часть причины их существования, кажется, заключается в том, чтобы подтолкнуть геймеров к использованию GPU Nvidia или удержать их там, если они уже используют продукцию Nvidia. Таким образом, позиция Nvidia по умолчанию — делать эти функции эксклюзивными для своих решений и заставлять таких конкурентов, как AMD, догонять. Так было всегда.

0 комментариев