ИИ поставил диагноз точнее врачей в исследовании Гарварда

Новое исследование изучает, как большие языковые модели работают в различных медицинских контекстах, включая реальные случаи из отделений неотложной помощи, где, по крайней мере, одна модель оказалась точнее врачей-людей.

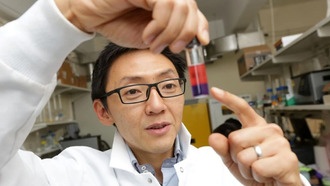

Исследование, опубликованное на этой неделе в журнале Science, было проведено командой исследователей под руководством врачей и компьютерщиков из Гарвардской медицинской школы и Медицинского центра Бет Исраэль Дьяконесса. Исследователи провели ряд экспериментов, чтобы сравнить модели OpenAI с врачами-людьми.

В одном из экспериментов ученые сосредоточились на 76 пациентах, поступивших в отделение неотложной помощи больницы Бет Исраэль. Они сравнили диагнозы, поставленные двумя врачами-терапевтами, с диагнозами, сгенерированными моделями OpenAI o1 и 4o. Эти диагнозы оценивались двумя другими лечащими врачами, которые не знали, какие из них принадлежат людям, а какие — ИИ.

«На каждом этапе диагностики o1 показывал результаты номинально лучше или наравне с двумя лечащими врачами и моделью 4o», — говорится в исследовании, добавляя, что различия «были особенно заметны на первом этапе диагностики (первичная сортировка в приемном покое), когда о пациенте известно меньше всего информации, а необходимость принять правильное решение наиболее высока».

В пресс-релизе Гарвардской медицинской школы об этом исследовании подчеркивается, что ученые «вообще не предварительно обрабатывали данные» — модели ИИ получали ту же информацию, которая была доступна в электронных медицинских картах на момент постановки каждого диагноза.

Используя эту информацию, модель o1 смогла предложить «точный или очень близкий диагноз» в 67% случаев сортировки, в то время как один врач ставил точный или близкий диагноз в 55% случаев, а другой — в 50%.

«Мы протестировали модель ИИ практически по всем критериям, и она превзошла как предыдущие модели, так и наши базовые показатели врачей», — заявил в пресс-релизе Арджун Манраи, возглавляющий лабораторию ИИ в Гарвардской медицинской школе и являющийся одним из ведущих авторов исследования.

Следует отметить, что исследование не утверждает, что ИИ готов принимать реальные решения о жизни и смерти в отделении неотложной помощи. Вместо этого оно говорит о том, что полученные результаты демонстрируют «острую необходимость в проспективных исследованиях для оценки этих технологий в условиях реального ухода за пациентами».

Исследователи также отметили, что они изучали только то, как модели работают с текстовой информацией, и что «существующие исследования показывают, что современные фундаментальные модели более ограничены в рассуждениях на основе нетекстовых данных».

Адам Родман, врач из больницы Бет Исраэль и один из ведущих авторов исследования, предупредил The Guardian, что «сейчас не существует формальной системы ответственности» за диагнозы, поставленные ИИ, и что пациенты по-прежнему «хотят, чтобы люди направляли их в решениях о жизни и смерти [и] направляли их в сложных решениях о лечении».

В посте об исследовании Кристен Пантагани, врач скорой помощи, назвала его «интересным исследованием ИИ, которое привело к появлению множества преувеличенных заголовков», особенно учитывая, что в нем сравнивались диагнозы ИИ с диагнозами врачей-терапевтов, а не врачей скорой помощи.

«Если мы собираемся сравнивать инструменты ИИ с клиническими способностями врачей, нам следует начать со сравнения с врачами, которые действительно практикуют в этой специальности, — сказала Пантагани. — Я не удивлюсь, если LLM сможет превзойти дерматолога на экзамене по нейрохирургии, [но] знать это не особенно полезно».

Она также утверждает: «Как врач скорой помощи, видящий пациента впервые, моя главная цель — не угадать ваш окончательный диагноз. Моя главная цель — определить, есть ли у вас состояние, которое может вас убить».

Этот пост и заголовок были обновлены, чтобы отразить тот факт, что диагнозы в исследовании ставили врачи-терапевты, и включить комментарий Кристен Пантагани.

0 комментариев