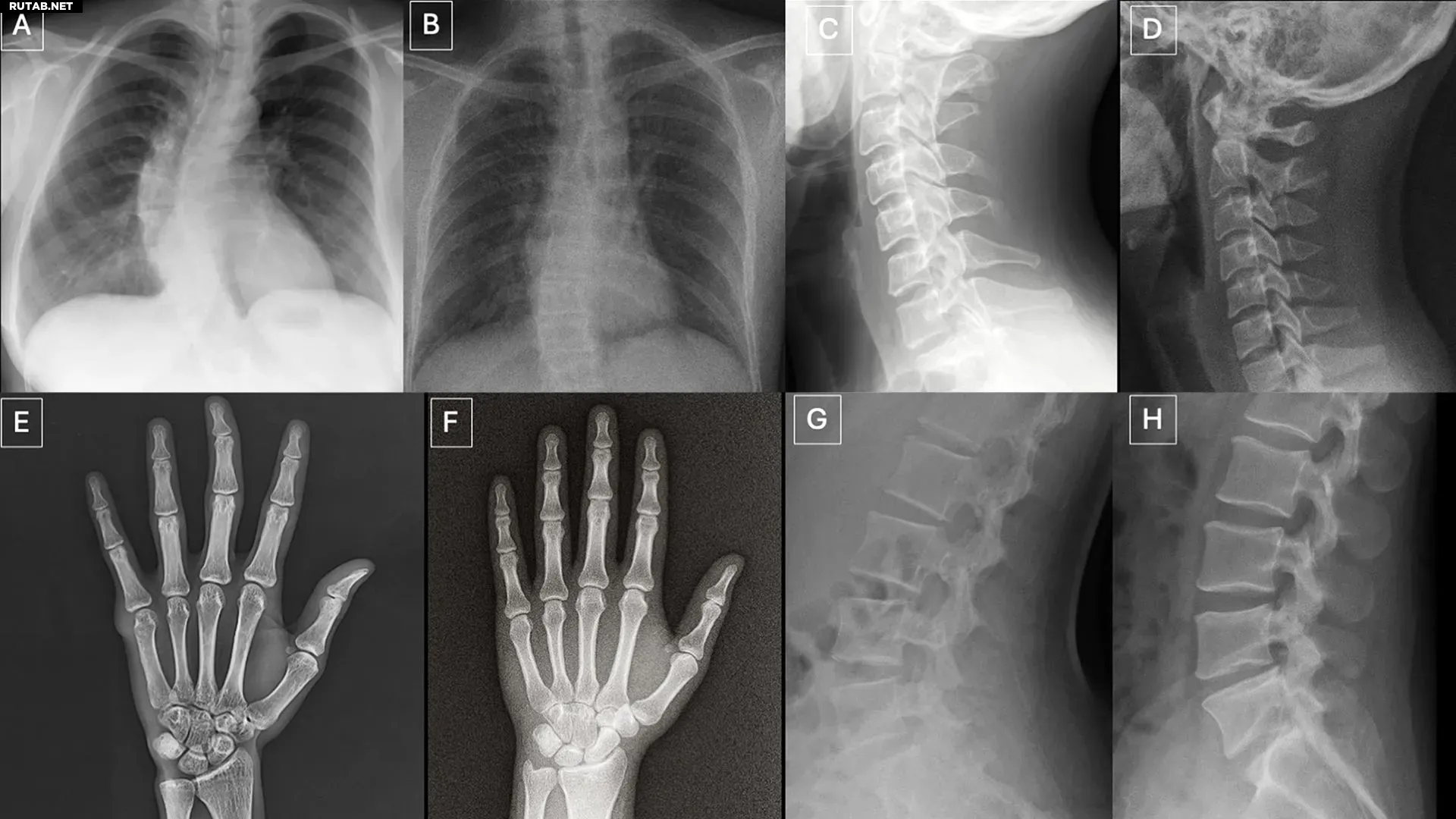

Искусственные рентгеновские снимки от ИИ обманывают даже опытных врачей

Новое исследование, опубликованное в журнале Radiology, показало, что как рентгенологи, так и современные мультимодальные языковые модели (LLM) с трудом отличают настоящие рентгеновские снимки от сгенерированных искусственным интеллектом «дипфейков». Это создаёт серьёзные риски для медицины.

В исследовании участвовали 17 рентгенологов из 12 учреждений в шести странах. Им показали 264 снимка, половина из которых была создана ИИ (ChatGPT и моделью RoentGen). Когда врачи не знали о наличии подделок, они распознали только 41% сгенерированных изображений. После предупреждения точность выросла в среднем до 75%, но результаты сильно варьировались от 58% до 92%.

Четыре мультимодальные LLM — GPT-4o, GPT-5, Gemini 2.5 Pro и Llama 4 Maverick — показали точность от 57% до 85%. Опыт врача не гарантировал успеха в обнаружении подделок.

Наше исследование показывает, что эти дипфейковые рентгеновские снимки достаточно реалистичны, чтобы обмануть рентгенологов, даже когда они знали о присутствии сгенерированных ИИ изображений, — заявил ведущий автор исследования Микаэль Торджман.

По его словам, это создаёт уязвимость для мошеннических судебных исков и кибератак на больничные сети.

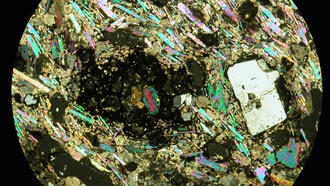

Исследователи отметили, что сгенерированные изображения часто выглядят «слишком идеально»: кости чрезмерно гладкие, позвоночник неестественно прямой, а переломы — необычно «чистыми».

Для снижения угроз учёные рекомендуют внедрять цифровые водяные знаки и криптографические подписи на снимках. Также они выпустили специальный набор данных с дипфейками для обучения медиков.

0 комментариев