Huawei Cloud представила гибкую интеллектуальную вычислительную систему FlexNPU для снижения стоимости обработки токенов

Huawei Cloud на презентации решений ИИ для малого и среднего бизнеса представила новую технологию в области вычислений — гибкую интеллектуальную вычислительную операционную систему FlexNPU. Её цель — эффективно контролировать расходы на обработку токенов, которые часто становятся «пожирателем бюджета», и обеспечить оптимальное соотношение цены и производительности токенов в эпоху агентного ИИ, помогая преодолеть вычислительные барьеры для внедрения корпоративных интеллектуальных агентов.

На уровне ИИ-инфраструктуры Huawei Cloud предлагает продукты Ascend нескольких поколений и собственную AI Infra OS. Технология гибких вычислений FlexNPU способна удовлетворить потребности малого и среднего бизнеса в обучении небольших моделей, а также значительно повысить утилизацию ресурсов за счёт эластичного планирования.

На уровне модельного сервиса Huawei Cloud поддерживает основные открытые модели отрасли, позволяя компаниям гибко выбирать модели, соответствующие бизнес-задачам, а также с низкими затратами дообучавать собственные модели на своих данных.

На уровне платформы для интеллектуальных агентов Huawei Cloud предоставляет удобную и эффективную среду разработки Agent, помогая разработчикам и малым предприятиям создавать корпоративных агентов для отраслевых сценариев. На уровне приложений Huawei Cloud совместно с партнёрами углублённо изучает такие частые сценарии, как аналитика, маркетинг и операции, совместная работа, разработка и эксплуатация (DevOps), создание контента и другие.

«Средняя утилизация нашего пула для инференса (вывода) оказалась ниже 30%. Дорогостоящие аппаратные вычислительные мощности ИИ, на которые потрачены огромные средства, часто насчитывающие десятки тысяч карт, более чем наполовину простаивают, «бездельничают и получают зарплату даром».

Такую поразительную статистику привёл на мероприятии главный архитектор Huawei Cloud, Huawei Fellow Гу Цзюнцзюн (Gu Jiongjiong). Он отметил, что в эпоху агентного ИИ компании повсеместно сталкиваются с вычислительными проблемами: автономное планирование агентом, многоитерационные процессы и длинный контекст приводят к экспоненциальному росту потребления токенов. Эффективное снижение стоимости токенов стало самой насущной и критической задачей.

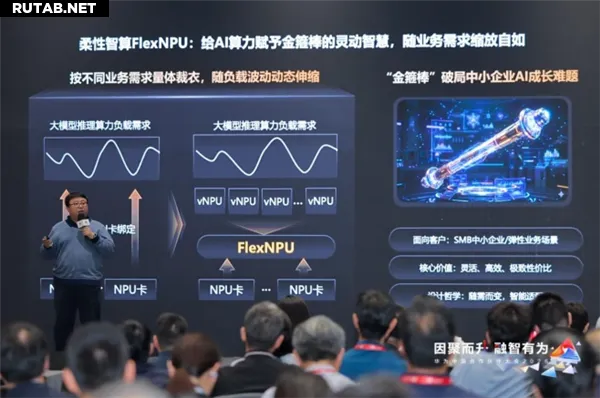

Для её решения Huawei Cloud выпустила гибкую интеллектуальную вычислительную систему FlexNPU. Благодаря созданию мощной и гибкой технологии планирования вычислительных ресурсов на уровне AI Infra, она значительно повышает эффективную утилизацию пулов для инференса. Таким образом, при тех же затратах на аппаратные мощности ИИ обеспечивается большая пропускная способность по токенам.

Гу Цзюнцзюн сравнил FlexNPU с «волшебной палицей Руй И Цзинь Гу Бан», которая «может быть и большой, и маленькой, меняясь по желанию». По его словам, FlexNPU придаёт вычислительным мощностям NPU или GPU способность к «гибкому или жидкому» предоставлению и масштабированию ресурсов. Они могут динамически меняться в соответствии с любыми бизнес-потребностями, двигаясь «по требованию». Максимизируя утилизацию инвестиций в ИИ-вычисления, в итоге достигается оптимизация стоимости токенов.

Конкретно, гибкая интеллектуальная вычислительная система FlexNPU обладает тремя ключевыми свойствами: максимальное совместное использование, максимальная эластичность и максимальная доступность.

В области инференса больших моделей FlexNPU, внедряя инновационные технологии, такие как динамическое совместное размещение (PD dynamic mixed deployment) на основе гибких вычислений и совместное размещение онлайн- и офлайн-инференса, решает проблемы неравномерной утилизации AI Core и видеопамяти в кластерах Prefill и Decode при традиционной раздельной архитектуре PD, а также проблему простоя большого количества ИИ-мощностей из-за циклических изменений нагрузки в инференсе. Это даёт как минимум 40%-ное улучшение соотношения цены и производительности токенов.

В области инференса малых моделей FlexNPU, реализуя разделение времени AI Core с минимальной гранулярностью до 1% карты NPU и разделение пространства видеопамяти с гранулярностью 128 МБ, предоставляет малым моделям идеально подходящие, «сшитые по мерке» виртуальные ресурсы NPU, снижая среднюю стоимость вычислений для малых моделей в 2–3 раза и более.

В области обеспечения высокой доступности инференса FlexNPU благодаря разделению программного и аппаратного обеспечения (soft-hard decoupling) и мгновенным снимкам (snapshot) KV Cache на уровне токенов позволяет фреймворкам верхнего уровня для инференса не зависеть от сбоев аппаратного обеспечения нижнего уровня. Это обеспечивает восстановление после сбоя за секунды и продолжение вывода с точки останова, значительно сокращая затраты на пересчёт сессий инференса агентов и улучшая пользовательский опыт.

ИИ: Представление Huawei Cloud FlexNPU выглядит как серьёзный шаг в решении одной из ключевых проблем современного ИИ — высокой стоимости инференса, особенно в контексте агентов. Подход с «гибкими» или «жидкими» вычислениями, повышающий утилизацию дорогостоящего оборудования, может стать важным фактором для более широкого внедрения корпоративных ИИ-решений, особенно среди малого и среднего бизнеса. Заявленное снижение стоимости вычислений для малых моделей в 2-3 раза звучит очень убедительно.

0 комментариев