Искусственные нейросети и люди демонстрируют сходные модели при обучении

Исследователи из Оксфордского университета обнаружили, что люди и искусственные нейронные сети (ИНС) демонстрируют схожие модели «интерференции» и «переноса» при последовательном обучении задачам, основанным на логических правилах.

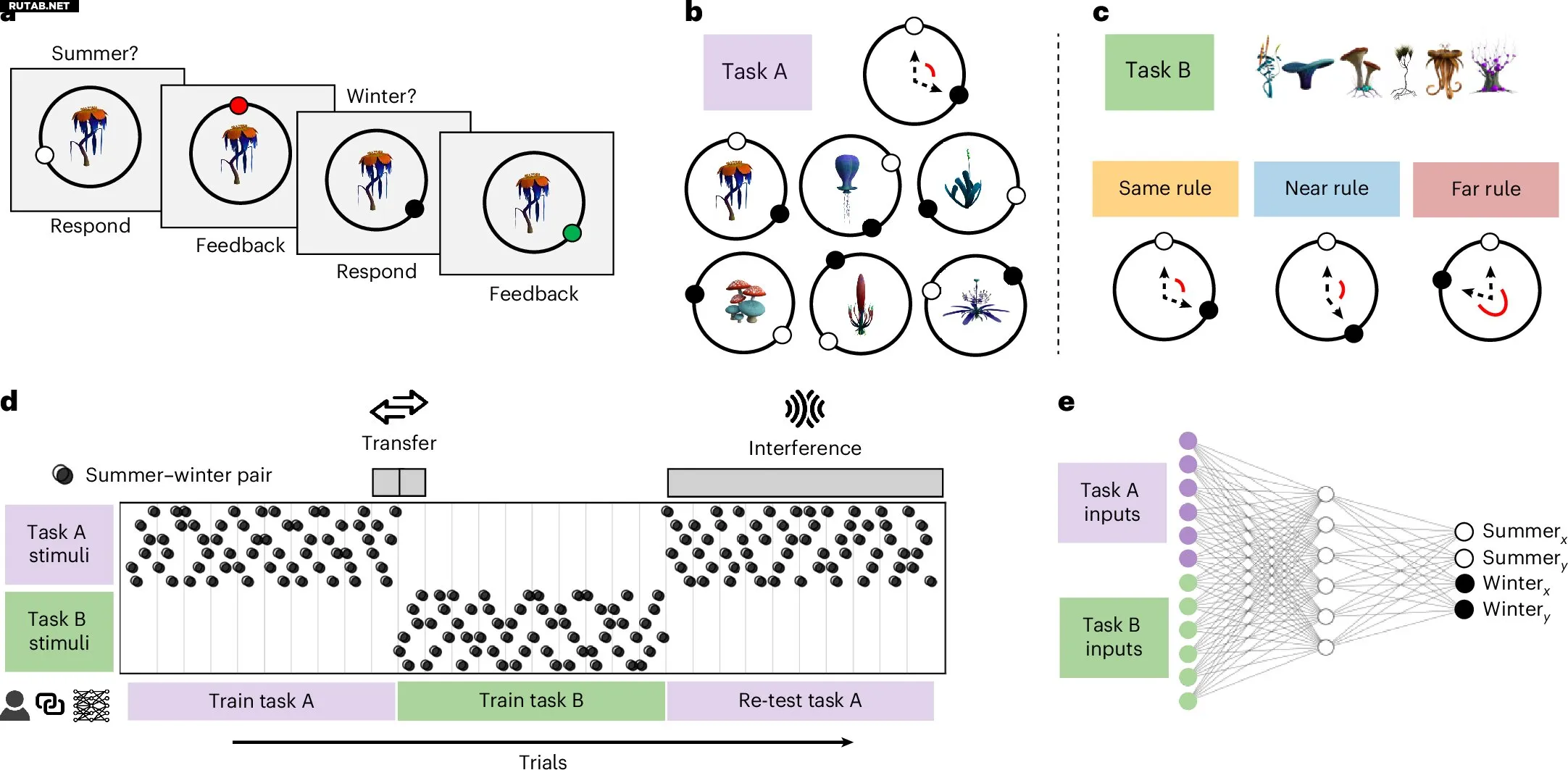

Интерференция — это явление, при котором изучение новой информации затрудняет воспроизведение ранее усвоенных знаний. В ИНС это проявляется как «катастрофическое забывание», когда модель «разучивается» выполнять предыдущие задачи после тренировки на новых данных.

В ходе эксперимента участники и нейросети выполняли последовательность задач по схеме A–B–A. Оказалось, что когда правила задач были схожи, и люди, и ИНС демонстрировали «перенос» — использование знаний из первой задачи для ускоренного обучения второй. Однако при возврате к первоначальным правилам (задача A) у многих наблюдалась интерференция.

«При обучении последовательным задачам оба типа учащихся получают больше пользы от предыдущих знаний, когда задачи похожи, но в результате также демонстрируют большую интерференцию при повторном тестировании», — отметили авторы исследования.

Учёные также выявили два типа учащихся среди людей: «объединители» (lumpers), которые демонстрируют высокий перенос знаний, но и высокую интерференцию, и «разделители» (splitters), которые избегают интерференции, но хуже переносят знания. Эти поведенческие профили соответствуют режимам обучения нейросетей — «богатому» (с перекрывающимися представлениями) и «ленивому» (с раздельными представлениями).

Результаты исследования, опубликованные в журнале Nature Human Behaviour, могут помочь в разработке более эффективных алгоритмов искусственного интеллекта и углубить понимание процессов обучения у людей.

0 комментариев