Ионно-электронный фотодетектор приближает встроенную обработку изображений в сенсорах

Встроенные преобразования изображений с использованием фотодетектора CIPS. Автор: Nature Communications (2025). DOI: 10.1038/s41467-025-62563-7

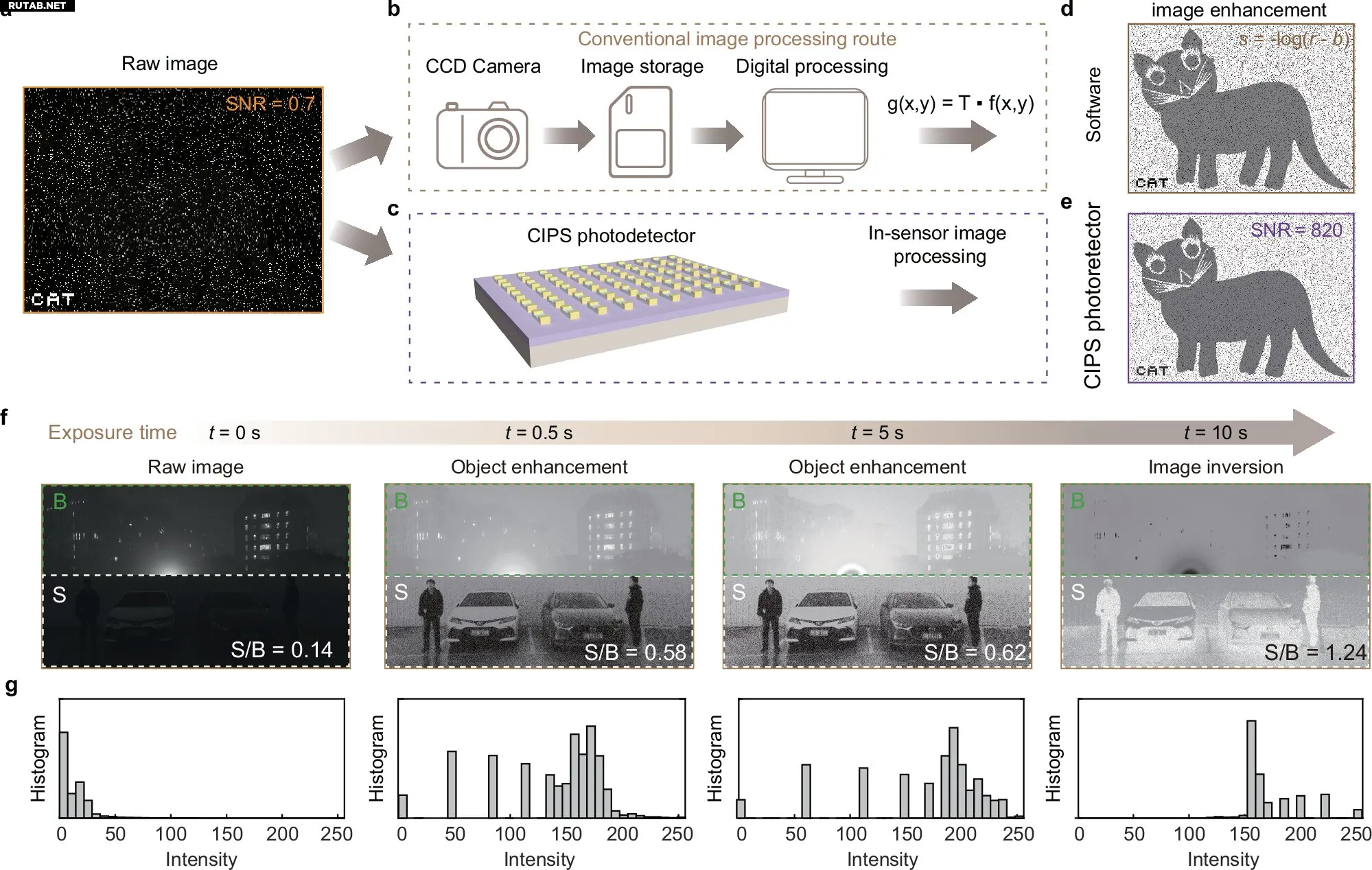

На стыке нейроморфной инженерии и фотоники исследователи разработали ионно-электронный фотодетектор, который не только фиксирует свет, но и выполняет обработку изображений непосредственно в сенсоре. Эта технология потенциально может преодолеть некоторые ограничения человеческого зрения, включая проблемы с цветовосприятием.

Исследование под названием «Ионно-электронный фотодетектор для помощи зрению со встроенной обработкой изображений» было опубликовано в журнале Nature Communications. Работу возглавили Хай Хуан, Цзяньлу Ван и их коллеги из Университета Фудань и Китайской академии наук.

Основу инновации составляет многослойный фотодетектор на основе сульфида меди-индия-фосфора (CIPS) — ван-дер-ваальсового сегнетоэлектрического материала, поддерживающего как ионную, так и электронную проводимость.

Благодаря движению ионов Cu+ устройство демонстрирует нелинейные и зависящие от истории фотоотклики, что позволяет динамически настраивать его чувствительность к свету. Эта перестраиваемость дает возможность выборочно усиливать слабые сигналы или подавлять переэкспонированные области — функциональность, которая может помочь компенсировать недостатки человеческого зрения, такие как слабая контрастная адаптация или цветовая дискриминация.

«Это шаг к встроенным вычислениям в сенсоре — парадигме, где часть вычислений физически встроена в сам датчик», — говорит ведущий автор Хай Хуан. «Вместо простого преобразования света в электрические сигналы наше устройство может обрабатывать информацию прямо во время захвата. Это не только снижает энергопотребление, но и обеспечивает быстрые адаптивные реакции зрения».

Особенно перспективным направлением является применение этой технологии для помощи людям с нарушениями цветового зрения (дальтонизмом). Способность устройства перераспределять спектральный контраст и модулировать чувствительность в реальном времени может обеспечить адаптивную предварительную обработку изображений — например, усиление контраста между красным и зеленым цветами.

Это открывает возможность создания чипов для визуальных протезов или вспомогательных устройств, улучшающих цветовое разделение и распознавание объектов в сложных сценах.

Фотодетектор также способен выполнять базовые операции с изображениями, такие как удаление шума, усиление контраста и инверсия — все это непосредственно в структуре устройства. Поскольку эти функции выполняются без внешних схем, конструкция избегает узких мест в передаче данных и энергозатрат, характерных для традиционных сенсоров и процессоров, что делает ее идеальной для энергоэффективных систем искусственного интеллекта.

Команда также продемонстрировала, что детектор обладает программируемыми фотооткликами, которые меняются в зависимости от истории освещения — например, переключение между положительным и отрицательным режимами реакции в зависимости от условий. Эти динамические свойства напоминают биологическую адаптацию зрения, но искусственная система предлагает более высокую настраиваемость и скорость.

«Будущее искусственного зрения — не просто копирование биологии, а выход за ее пределы», — говорит Хуан. «С ионно-электронными материалами мы можем встраивать интеллект на уровне материала. Это открывает возможности для адаптации в реальном времени, включая потенциальные преимущества для людей с нарушениями зрения».

В перспективе исследователи планируют масштабировать технологию для создания двумерных сенсорных матриц и изучат ее интеграцию в нейроморфные системы обработки изображений. Хотя улучшение зрения при дальтонизме остается долгосрочной целью, эта работа закладывает основу для нового класса «умных» пикселей, стирающих грань между восприятием и обработкой информации.

Дополнительная информация: Zhipeng Zhong et al, Ionic-electronic photodetector for vision assistance with in-sensor image processing, Nature Communications (2025). DOI: 10.1038/s41467-025-62563-7

Источник: Fudan University

0 комментариев