DeepSeek V4 получит поддержку FP4 и оптимизацию для видеокарт NVIDIA

Дата выхода новой языковой модели DeepSeek V4 стала горячей темой, и весьма вероятным считается релиз в конце апреля. Пользователи сети обнаружили значительные изменения в репозитории DeepSeek на GitHub, выявившие интересные улучшения.

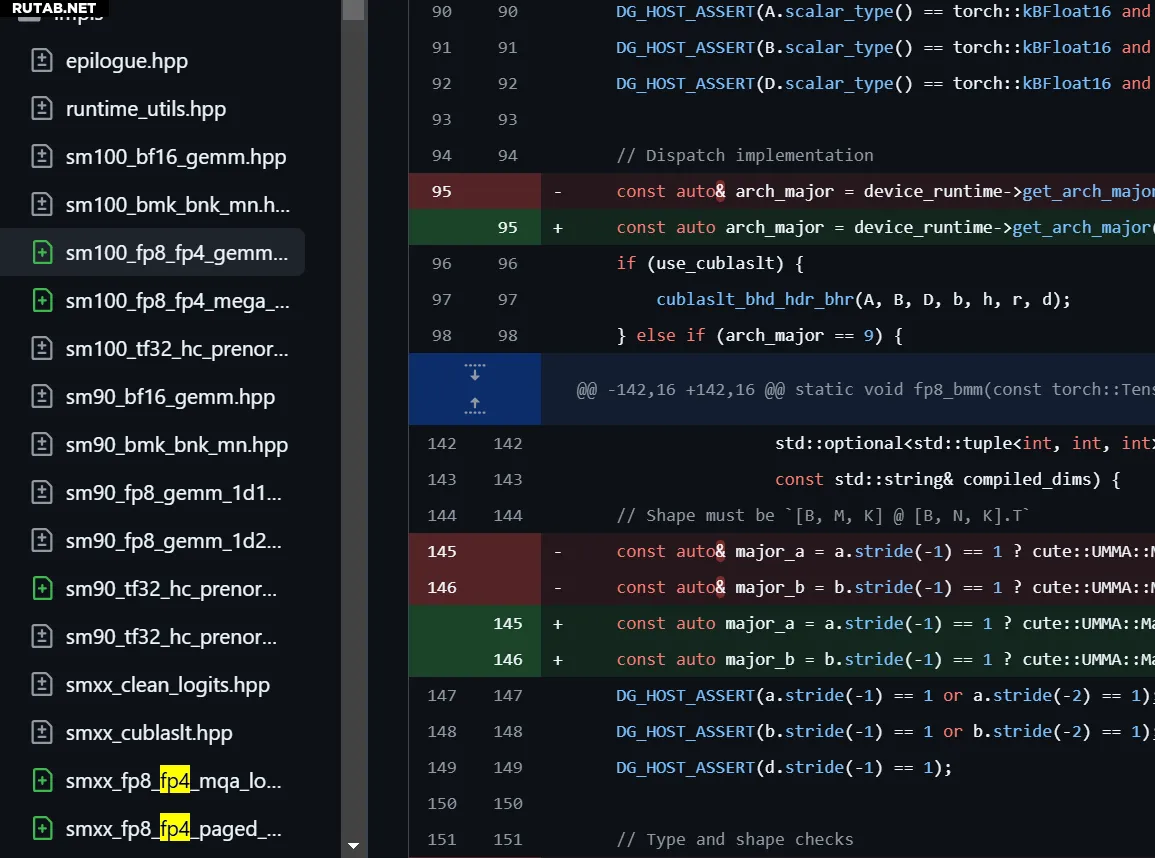

Исследователи DeepSeek обновили 110 файлов в официальном репозитории DeepGEMM, содержащих большое количество информации.

Во-первых, обеспечена широкая поддержка точности FP8 и FP4. Поддержка FP8 была подтверждена ранее, но поддержка FP4 всё ещё является относительно новой и радикальной для 2026 года. Она обладает большей производительностью и теоретически требует вдвое меньше памяти, чем FP8, что указывает на очень большой масштаб модели V4.

Во-вторых, модель оптимизирована для графических процессоров NVIDIA архитектур SM100/Blackwell. Ранее ходили слухи, что DeepSeek V4 станет первым продуктом, выпущенным для китайских платформ искусственного интеллекта, особенно для Huawei Ascend, но это не означает, что модель поддерживает только отечественные платформы. На данном этапе платформа искусственного интеллекта NVIDIA по-прежнему незаменима.

Оптимизация архитектур FP4 и Blackwell дополняет друг друга, поскольку поддержка алгоритма FP4 от NVIDIA является одной из самых стабильных из доступных в настоящее время.

В этом обновлении репозитория также сообщается, что DeepSeek V4 будет использовать новую архитектуру — Mega MoE и HyperConnection. Обе они подходят для обработки чрезвычайно больших объемов параметров, что предполагает, что масштаб V4 также будет значительным. Ранее предполагалось, что он будет обрабатывать триллионы параметров, но с учетом оптимизации этих двух архитектур и их поддержки новейшим оборудованием и алгоритмами ИИ, мы, возможно, можем ожидать еще более высокой производительности.

Самая большая известная модель имеет до 100 000 параметров, но такие модели либо все еще находятся в процессе обучения, либо это модели, подобные Mythos, параметры которых до сих пор не определены. К этой категории относятся модели с более чем 5 триллионами параметров, такие как Claude Opus 4.6 и предполагаемая, но еще не выпущенная GPT-6.

Самая большая из когда-либо произведенных в Китае моделей имеет 2,4 триллиона параметров, но ее производительность посредственна, и она малоизвестна. Другие модели с немного большим количеством параметров находятся в диапазоне триллионов. Kimi K 2.5 находится в диапазоне триллионов, серия DeepSeek V3.X — на уровне 670 миллиардов, а GLM-5.X имеет более 740 миллиардов параметров.

Таким образом, на основе всесторонней оценки, DeepSeek V4, благодаря поддержке многочисленных новых технологий, достиг уровня обработки триллионов параметров в качестве своей базовой возможности. Если он сможет преодолеть отметку в 2 триллиона параметров, его производительность должна быть весьма впечатляющей.

Если DeepSeek V4 с первого раза преодолеет отметку в 5 триллионов, он может стать ведущей мировой моделью, подобной DeepSeek R1 прошлого года. Однако это маловероятно, и для этого потребуются очень высокие затраты, что не соответствует стилю DeepSeek. Следующего прорыва, возможно, стоит ждать от DeepSeek V5 в следующем году.

Интересный факт: Поддержка формата FP4 (4-битной плавающей запятой) для инференса больших языковых моделей — это передовой рубеж в оптимизации. Она позволяет значительно сократить требования к памяти видеокарты, что критически важно для развертывания триллионных моделей на потребительском или доступном корпоративном оборудовании. Это может сделать мощные ИИ-модели более доступными.

0 комментариев