Минобороны США назвало «красные линии» Anthropic угрозой национальной безопасности

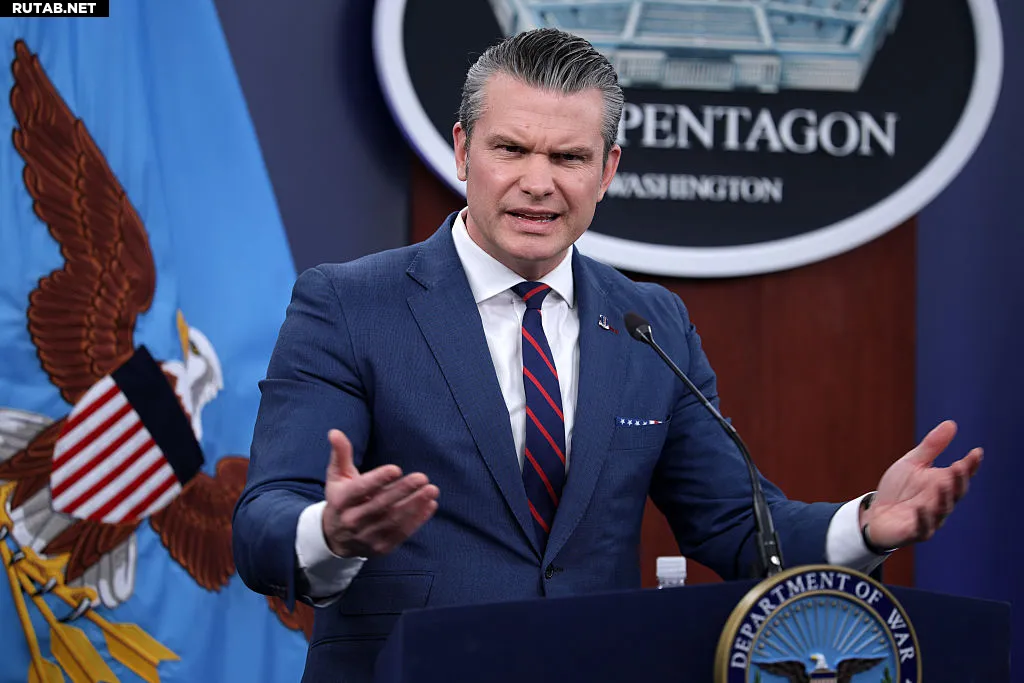

Министерство обороны США заявило во вторник вечером, что компания Anthropic представляет «неприемлемый риск для национальной безопасности». Это первый официальный ответ ведомства на иски ИИ-лаборатории, оспаривающие решение министра обороны Пита Хегсета, принятое в прошлом месяце, о признании компании риском для цепочки поставок. В рамках своих жалоб Anthropic просила суд временно заблокировать Минобороны от применения этого ярлыка.

Суть аргументации Пентагона, изложенной в 40-страничном документе, поданном в федеральный суд Калифорнии, заключается в опасении, что Anthropic может «попытаться отключить свою технологию или упреждающе изменить поведение своей модели» до или во время «боевых операций», если компания «сочтет, что ее корпоративные "красные линии" пересечены».

Летом прошлого года Anthropic подписала контракт с Пентагоном на 200 миллионов долларов (~16 млрд рублей) на внедрение своей технологии в классифицированных системах. В ходе последующих переговоров об условиях контракта Anthropic заявила, что не хочет, чтобы ее ИИ-системы использовались для массовой слежки за американцами, и что технология не готова для использования в принятии решений о наведении или применении летального оружия. Пентагон возразил, что частная компания не должна диктовать, как военные используют технологии.

В ответ представитель Anthropic сослался на заявление генерального директора Дарио Амодеи в конце февраля:

«Anthropic понимает, что решения по военным вопросам принимает Министерство обороны, а не частные компании. Мы никогда не выдвигали возражений против конкретных военных операций и не пытались ограничить использование нашей технологии в произвольном порядке».

Крис Маттеи, юрист, специализирующийся на вопросах Первой поправки и бывший сотрудник Министерства юстиции, заявил TechCrunch, что не проводилось никакого расследования в поддержку опасений Минобороны о возможном отключении или изменении ИИ-моделей Anthropic во время боевых операций. Без этих доказательств аргументация ведомства не может адекватно объяснить, как позиция компании на переговорах превратила ее во «враждебную сторону», утверждает Маттеи.

«Правительство полностью полагается на догадки, спекуляции и фантазии, чтобы оправдать очень, очень серьезный правовой шаг, который они предприняли против Anthropic», — сказал Маттеи.Он добавил, что ведомству не удалось «сформулировать правдоподобное или даже понятное обоснование того, почему отказ Anthropic согласиться на положение об "использовании в любых законных целях" превратил ее в риск для цепочки поставок, а не просто в поставщика, с которым Минобороны не захотело иметь дело».

Многие организации выступили против обращения Минобороны с Anthropic, утверждая, что ведомство могло просто расторгнуть контракт. Несколько технологических компаний и сотрудников — включая OpenAI, Google и Microsoft — а также правозащитные группы подали в суд письма в поддержку Anthropic.

В своих исках Anthropic обвинила Минобороны в нарушении ее прав по Первой поправке и наказании компании по идеологическим мотивам.

«Во многих отношениях абсурдные аргументы правительства сами по себе являются лучшим доказательством того, что действия администрации были явно карательным наказанием за отказ Anthropic согласиться с условиями правительства, что, вопреки утверждениям правительства в документе, является защищенной формой выражения», — заявил Маттеи TechCrunch.

Слушание по ходатайству Anthropic о предварительном судебном запрете назначено на следующий вторник.

Представитель Anthropic сообщил TechCrunch, что решение компании обратиться в суд не меняет ее «давней приверженности использованию ИИ для защиты национальной безопасности», но это «необходимый шаг» для защиты ее бизнеса, клиентов и партнеров.

Интересный факт: Компания Anthropic была основана в 2021 году бывшими сотрудниками OpenAI, включая Дарио Амодеи, которые покинули организацию из-за разногласий по поводу направления развития ИИ и его безопасности. Их флагманская модель Claude известна своими строгими принципами безопасности и конституционным подходом к разработке ИИ, что и стало причиной текущего конфликта с военным ведомством США.

0 комментариев