NVIDIA представила систему Vera Rubin: 7 чипов в одном решении, производительность выросла в 40 млн раз

На конференции GTC NVIDIA анонсировала множество важных продуктов, среди которых платформа Vera Rubin станет ключевой для поставок в этом году и, по заявлениям компании, является самой мощной AI-платформой на текущий момент.

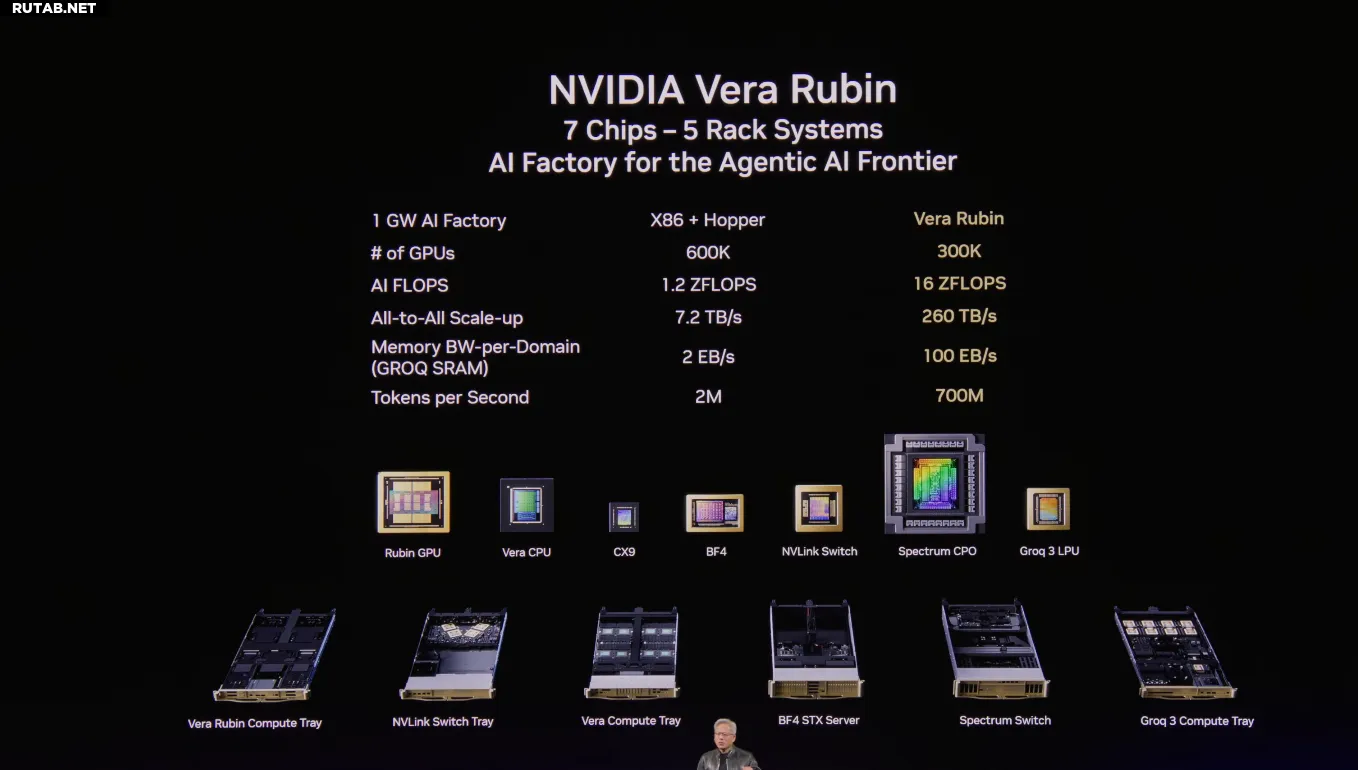

Vera Rubin — это не просто AI-ускоритель, а сложная комплексная система, состоящая из семи различных чипов и пяти стоек. Ранее сообщалось о шести чипах, но теперь в состав вошли: GPU Rubin, CPU Vera, интерконнект NVLink 6.0, SuperNIC ConnectX-9, DPU BlueField-4, сетевой коммутатор Spectrum-6 и, что ново, LPU Groq 3. Последний стал доступен NVIDIA после приобретения лицензии на технологию LPU за 200 миллиардов долларов в конце прошлого года и ориентирован на задачи AI-инференса.

Эти семь чипов работают в пяти различных стойках: Vera Rubin NVL72, Vera CPU, Groq 3 LPX, BlueField-4 STX для хранения данных и Spectrum-6 SPX для Ethernet. Только вместе они формируют законченную систему.

Итоговые характеристики платформы впечатляют: производительность до 3,6 экзафлопс (1 экзафлопс = 10^18 операций с плавающей запятой в секунду), полная пропускная способность сети 260 ТБ/с, 100% жидкостное охлаждение и скорость генерации токенов — 700 миллионов в секунду.

Чтобы проиллюстрировать масштаб прогресса, генеральный директор NVIDIA Дженсен Хуанг привёл сравнение: по его словам, Vera Rubin в 40 миллионов раз производительнее вычислительных систем десятилетней давности. Впрочем, с какой именно системой идёт сравнение, не уточняется.

Учитывая известную склонность Хуанга к эффектным сравнениям, к цифре в 40 миллионов раз стоит относиться как к демонстрации колоссального скачка, а не к точному метрическому benchmark. Десять лет назад концепции AI-производительности в современном понимании и поддержки форматов вроде FP4 просто не существовало, так что превосходство Vera Rubin над старыми топовыми системами ожидаемо.

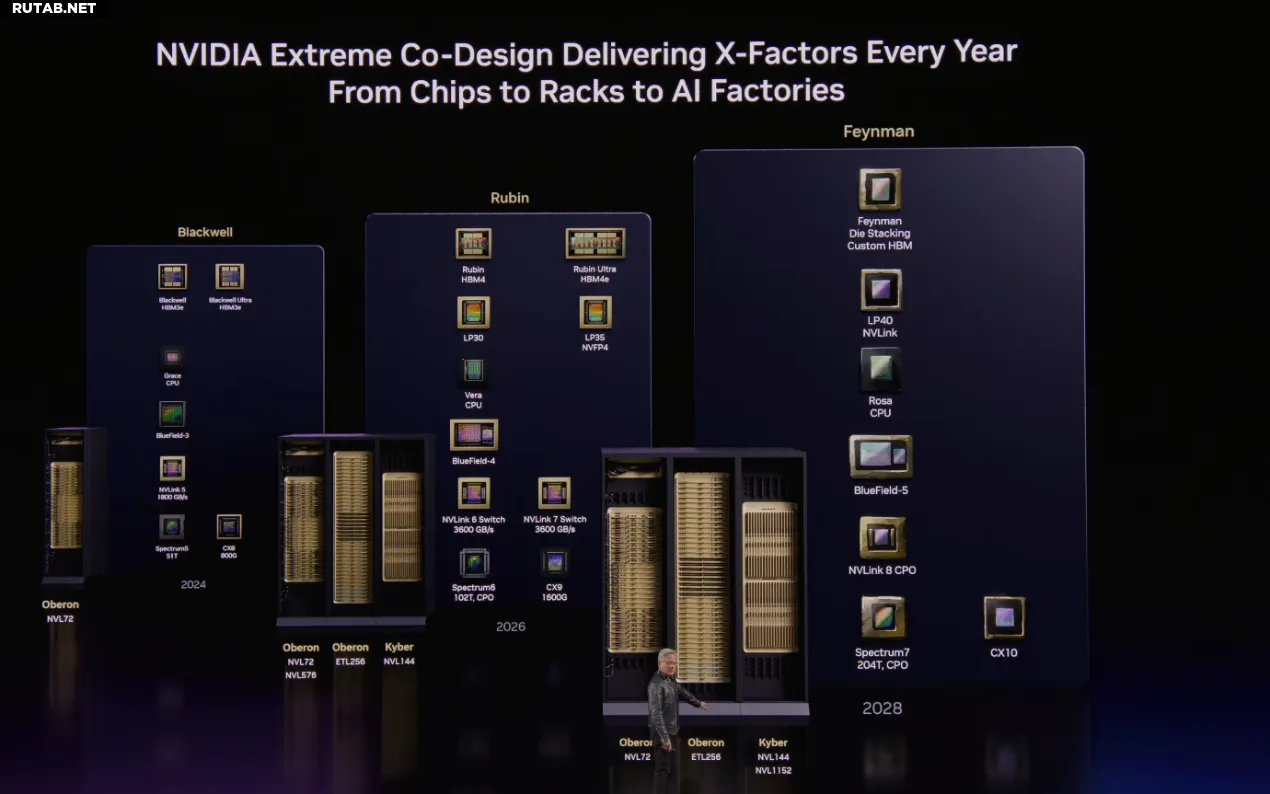

При этом Vera Rubin — ещё не предел для NVIDIA. В планах компании — выпуск версии Vera Rubin Ultra, где количество GPU увеличится с 72 до 144, что, вероятно, позволит удвоить производительность.

В дальнейшем NVIDIA готовит переход на следующее GPU-ядро под кодовым названием Feynman (Фейнман), которое будет производиться по техпроцессу TSMC A16 (1,6 нм) с использованием 3D-упаковки и специальной памяти HBM. Его будут сопровождать чипы нового поколения, такие как LP40 LPU, NVLink 8.0 и CX10. Ожидается, что эта архитектура выйдет в 2028 году.

ИИ: Представление Vera Rubin — это очередной мощный ход NVIDIA по консолидации рынка AI-инфраструктуры. Компания явно движется от поставок отдельных ускорителей к созданию комплексных, «закрытых» систем, где все компоненты оптимизированы друг под друга. Это даёт максимальную производительность, но также усиливает зависимость клиентов от экосистемы NVIDIA. Битва за дата-центры будущего идёт на уровне целых платформ, а не просто чипов.

0 комментариев