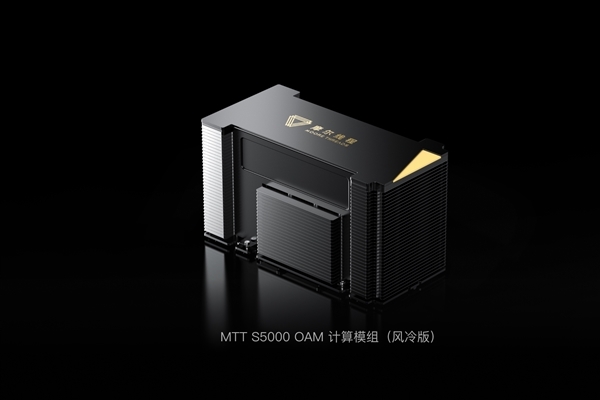

Модели Qwen3.5 от Alibaba получили поддержку GPU MTT S5000 от Moore Threads

После открытия исходного кода крупномасштабной модели Qwen3.5-397B-A17B, компания Alibaba (阿里巴巴) снова открыла исходный код трёх новых моделей среднего масштаба серии Qwen3.5: Qwen3.5-35B-A3B, Qwen3.5-122B-A10B и Qwen3.5-27B.

Компания Moore Threads (摩尔线程) оперативно отреагировала и выполнила всестороннюю адаптацию этих трёх новых моделей для своего флагманского универсального GPU для обучения и вывода MTT S5000.

Эта эффективная поддержка в полной мере демонстрирует зрелость и полноту экосистемы MUSA от Moore Threads.

В процессе адаптации моделей серии Qwen3.5 были подтверждены две ключевые возможности экосистемы MUSA для разработчиков:

▼ Нативная поддержка MUSA C:

Позволяет разработчикам напрямую использовать MUSA C для разработки ядер, значительно снижая порог миграции из экосистемы CUDA.

▼ Глубокая совместимость с Triton-MUSA:

Разработчики могут использовать знакомый синтаксис Triton для написания высокопроизводительных операторов, которые с помощью бэкенда Triton-MUSA будут работать на универсальных GPU Moore Threads.

На уровне базовых технологий, для гибридного механизма внимания, используемого в мультимодальной модели Qwen3.5, Moore Threads реализовала нативную оптимизацию.

На основе вычислительной библиотеки muDNN и библиотеки операторов с открытым исходным кодом MATE, Moore Threads обеспечила эффективную поддержку обработки длинных последовательностей в гибридном механизме внимания, успешно реализовав высокопроизводительный вывод этой модели на MTT S5000.

От GLM-5 и MiniMax M2.5 до Kimi K2.5 и серии Qwen3.5, сверхбыстрая адаптация Moore Threads к передовым большим моделям уже стала обычной практикой.

MTT S5000 — это универсальная GPU-карта для интеллектуальных вычислений, разработанная Moore Threads специально для обучения больших моделей, вывода и высокопроизводительных вычислений. Она основана на архитектуре MUSA четвёртого поколения «Пинху» (平湖) и нативно адаптирована к таким популярным фреймворкам, как PyTorch, Megatron-LM, vLLM и SGLang.

Одна карта MTT S5000 оснащена до 80 ГБ видеопамяти с пропускной способностью до 1,6 ТБ/с, что на 67% и 113% соответственно больше, чем у предыдущего поколения MTT S4000. Пропускная способность межсоединения между несколькими картами также составляет 784 ГБ/с.

Она полностью поддерживает вычисления с полной точностью от FP8 до FP64 и является одной из первых GPU для обучения в Китае с нативной поддержкой точности FP8, оснащённой аппаратным ускорителем Tensor Core FP8.

Максимальная производительность ИИ-вычислений с точностью FP8 на одной карте может достигать 1000 TFLOPS, впервые достигнув уровня PFLOPS (квадриллион операций в секунду). Фактические тесты производительности показывают, что она может конкурировать с NVIDIA H100, особенно в задачах тонкой настройки мультимодальных больших моделей, где некоторые показатели производительности даже превосходят H100 и начинают приближаться к новейшей архитектуре Blackwell.

0 комментариев