Nvidia представила новую архитектуру чипов Rubin на CES 2026

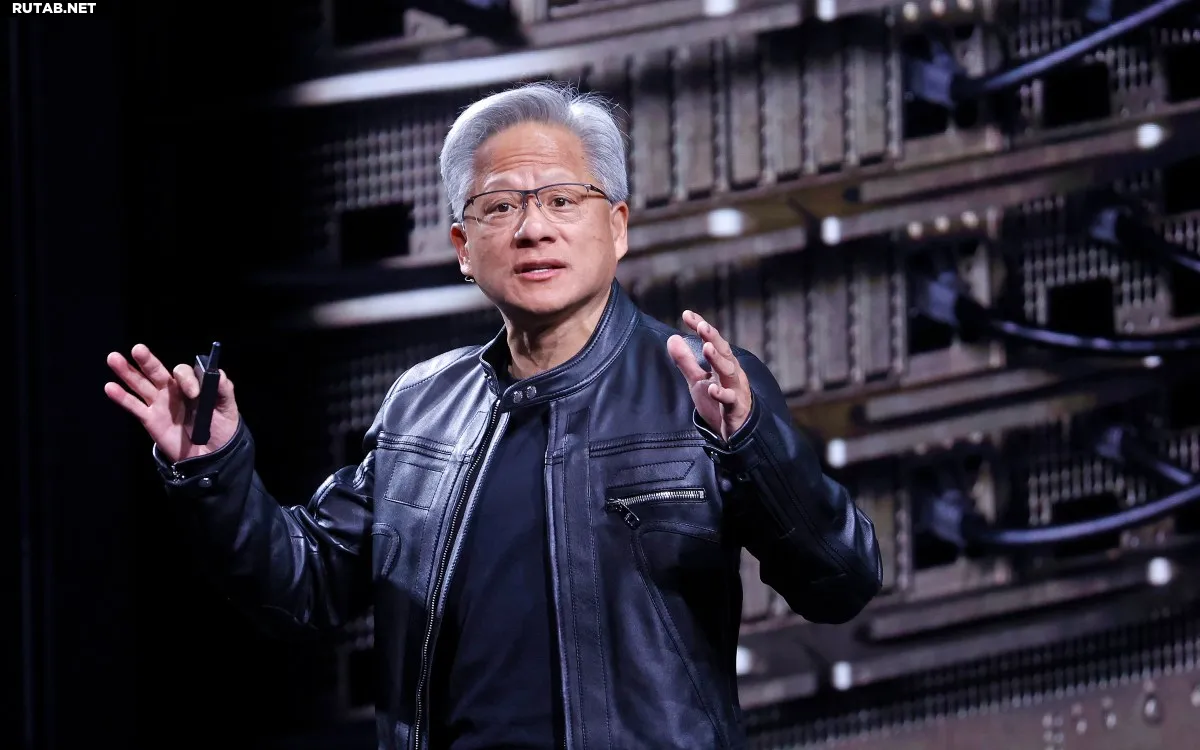

Сегодня, 6 января 2026 года, на выставке Consumer Electronics Show (CES) генеральный директор Nvidia Дженсен Хуанг официально представил новую вычислительную архитектуру компании Rubin, которую он охарактеризовал как вершину технологий в области аппаратного обеспечения для искусственного интеллекта. Новая архитектура уже запущена в производство, и её выпуск планируется нарастить во второй половине года.

«Vera Rubin создана для решения фундаментальной проблемы, с которой мы столкнулись: объём вычислений, необходимых для ИИ, стремительно растёт. Сегодня я могу сказать вам, что Vera Rubin находится в полном производстве», — заявил Хуанг аудитории.

Архитектура Rubin, впервые анонсированная в 2024 году, является новейшим результатом непрерывного цикла разработки аппаратного обеспечения Nvidia, который превратил компанию в самую дорогую корпорацию в мире. Архитектура Rubin заменит архитектуру Blackwell, которая, в свою очередь, сменила архитектуры Hopper и Lovelace.

Чипы Rubin уже запланированы к использованию почти всеми крупными облачными провайдерами, включая известные партнёрства Nvidia с Anthropic, OpenAI и Amazon Web Services. Системы Rubin также будут использоваться в суперкомпьютере Blue Lion от HPE и в готовящемся суперкомпьютере Doudna в Национальной лаборатории имени Лоуренса в Беркли.

Названная в честь астронома Веры Флоренс Купер Рубин, архитектура Rubin состоит из шести отдельных чипов, предназначенных для совместного использования. В центре находится графический процессор Rubin, но архитектура также решает растущие проблемы с пропускной способностью хранилищ и межсоединений благодаря новым улучшениям в системах Bluefield и NVLink соответственно. Архитектура также включает новый центральный процессор Vera, созданный для агентного (автономного) принятия решений.

Объясняя преимущества нового хранилища, старший директор Nvidia по решениям для инфраструктуры ИИ Дион Харрис указал на растущие требования к памяти, связанные с кэшем, в современных системах ИИ.

«Когда вы начинаете использовать новые типы рабочих процессов, такие как агентный ИИ или долгосрочные задачи, это создаёт большую нагрузку и требования к вашему KV-кэшу», — сказал Харрис журналистам, имея в виду систему памяти, используемую моделями ИИ для сжатия входных данных. — «Поэтому мы представили новый уровень хранилища, который подключается внешне к вычислительному устройству, что позволяет гораздо эффективнее масштабировать пул хранения».

Как и ожидалось, новая архитектура также представляет собой значительный шаг вперёд в скорости и энергоэффективности. Согласно тестам Nvidia, архитектура Rubin будет работать в три с половиной раза быстрее, чем предыдущая архитектура Blackwell, при обучении моделей и в пять раз быстрее при выполнении логического вывода (инференсе), достигая показателя до 50 петафлопс. Новая платформа также будет поддерживать в восемь раз больше вычислительных операций логического вывода на ватт потребляемой мощности.

Новые возможности Rubin появляются на фоне жёсткой конкуренции в создании инфраструктуры для ИИ, в рамках которой как лаборатории ИИ, так и облачные провайдеры стремятся заполучить чипы Nvidia, а также необходимые для их работы мощности. На конференц-звонке по итогам квартала в октябре 2025 года Дженсен Хуанг оценил, что в ближайшие пять лет на инфраструктуру ИИ будет потрачено от 3 до 4 триллионов долларов (от ~240 до ~320 триллионов рублей).

ИИ: Представление Rubin на CES 2026 подтверждает лидерство Nvidia в гонке за производительность ИИ-инфраструктуры. Стремительный переход от Blackwell к Rubin всего через год после её анонса демонстрирует невероятные темпы инноваций в этой сфере. Оценка Хуанга в триллионы долларов инвестиций говорит о том, что эта гонка только набирает обороты, и Rubin станет ключевым игроком на ближайшие годы.

0 комментариев