Две системы NVIDIA DGX Spark объединили с Mac Studio на M3 Ultra для создания мощной системы LLM

Основной проект EXO Labs — это EXO, фреймворк с открытым исходным кодом для эффективного запуска больших языковых моделей (LLM) в смешанных аппаратных конфигурациях. Вместо того чтобы рассматривать инференс как задачу, привязанную к одному GPU или акселератору, EXO автоматически распределяет рабочие нагрузки по всем доступным устройствам — превращая кластер из настольных компьютеров, ноутбуков, рабочих станций, серверов, планшетов или даже смартфонов в совместную AI-сеть. В новой демонстрации EXO объединили две системы NVIDIA DGX Spark с Mac Studio на базе Apple M3 Ultra, чтобы использовать различные сильные стороны каждой машины: у Spark больше вычислительной мощности, а Mac Studio может перемещать данные гораздо быстрее. EXO 1.0, находящийся в настоящее время в раннем доступе, объединяет обе системы в единый конвейер инференса, и, по всей видимости, это работает на удивление хорошо.

Две системы NVIDIA DGX Spark, соединённые с Mac Studio с помощью 10-гигабитного Ethernet для распределённого AI-инференса. / Изображение: EXO Labs

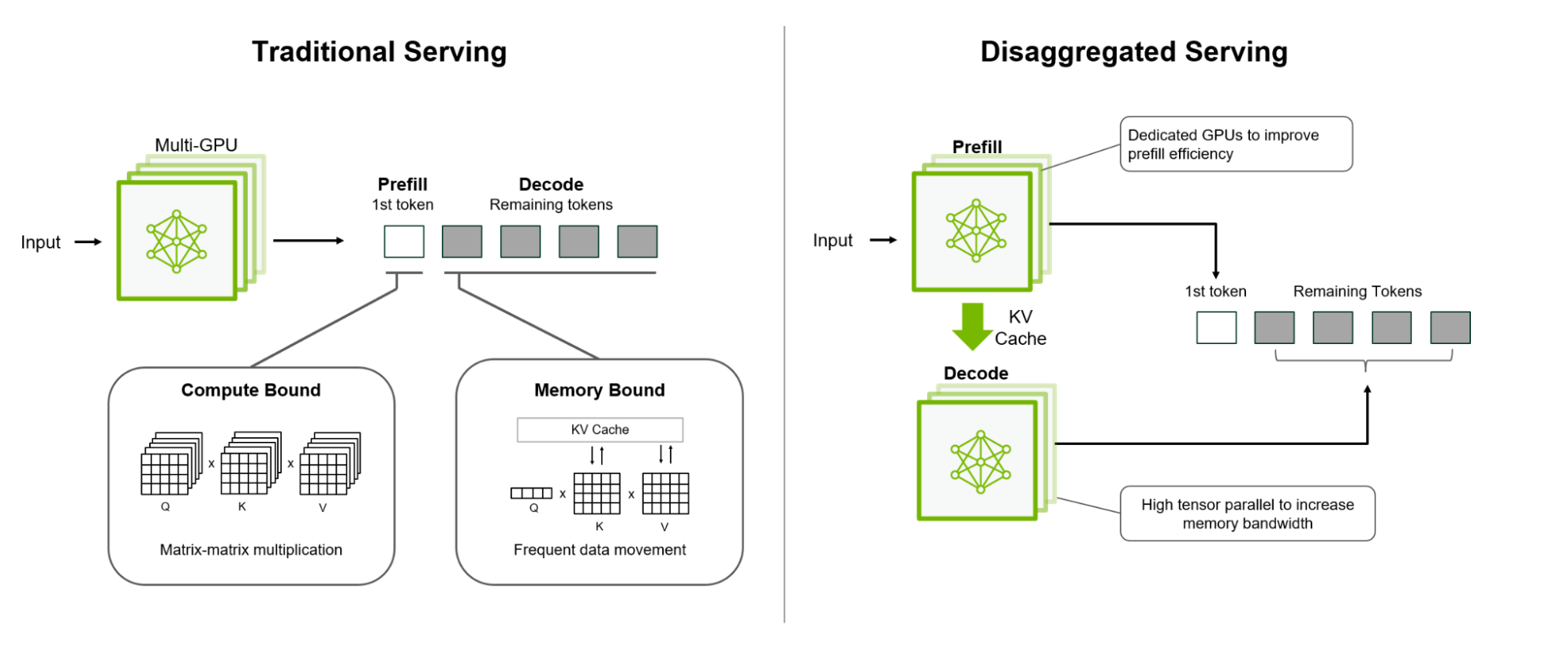

Чтобы понять, как это работает, нужно знать, что инференс LLM состоит из двух различных фаз: сначала стадия предварительного заполнения (prefill), когда модель читает и обрабатывает промпт пользователя. Эта часть ограничена вычислительной мощностью, а значит, выигрывает от мощных GPU, таких как чип Blackwell в DGX Spark. Затем следует фаза декодирования, которая генерирует токены один за другим. Этот шаг сильно ограничен пропускной способностью, что делает сверхширокую шину памяти M3 Ultra идеальной. Хитрость EXO заключается в том, чтобы разделить эти фазы между машинами, передавая внутренние данные модели (так называемый KV-кэш) слой за слоем, чтобы две системы могли работать одновременно, не дожидаясь друг друга.

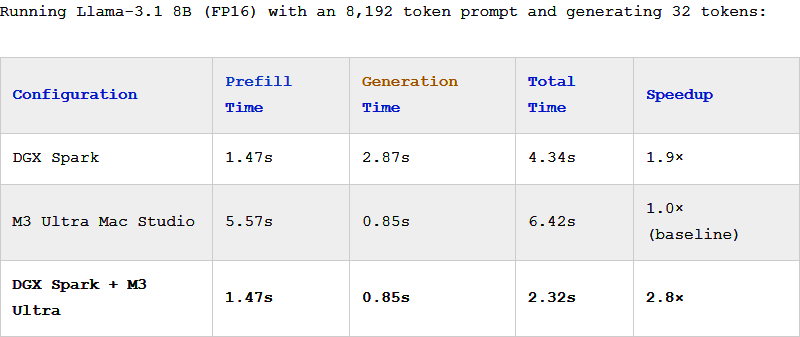

Результаты производительности из публикации в блоге EXO Labs. Изображение: EXO Labs

В тесте EXO с моделью Meta Llama-3.1 8B гибридная установка показала почти трёхкратное ускорение по сравнению с использованием только Mac Studio — соответствуя скорости предварительного заполнения DGX Spark при сохранении быстрого времени генерации M3 Ultra. В результате общий прирост составил 2,8×, и это было достигнуто с промптом длиной 8K токенов на относительно небольшой модели 8B. Более длинные промпты или более крупные модели должны показать ещё больший прирост.

Такой «распределённый инференс» не является чем-то совершенно новым, но он всё равно очень умный. Это намекает на будущее, где производительность AI масштабируется не за счёт покупки одного массивного акселератора, а за счёт более интеллектуальной оркестрации уже имеющегося оборудования. NVIDIA, кажется, согласна: её будущая платформа Rubin CPX будет использовать вычислительно-плотные процессоры Rubin CPX для фазы предварительного заполнения контекста, в то время как стандартные чипы Rubin с огромной пропускной способностью памяти HBM3e будут обрабатывать фазу декодирования — тот же принцип, который EXO уже демонстрирует на готовом оборудовании.

Фреймворк Dynamo от NVIDIA служит аналогичной цели, но без функции автоматической подписки на устройства, как в EXO. Изображение: NVIDIA

Релиз EXO в раннем доступе всё ещё находится на экспериментальной стадии. Текущая версия с открытым исходным кодом (0.0.15-alpha) датируется мартом 2025 года, а полная сборка 1.0 — с автоматическим планированием, потоковой передачей KV и гетерогенными оптимизациями — ещё не является публичной. Это не plug-and-play программное обеспечение для потребителей, по крайней мере, пока нет; на данный момент это инструмент исследовательского уровня, доказывающий, что распределённый инференс может дать реальные преимущества.

Тем не менее, это захватывающая демонстрация концепции. Интеллектуально используя смешанное оборудование, EXO показывает, что высокопроизводительный AI не обязательно должен быть монополизирован дата-центрами. Этого достаточно, чтобы задуматься о потенциале устройств, которые находятся вокруг вас в офисе.

Источник: Tomshardware.com

* Meta, Facebook и Instagram запрещены в России.

2 комментария