Google Gemma 4 официально оптимизирована для видеокарт NVIDIA RTX

Google совместно с NVIDIA оптимизировала новейшее семейство открытых языковых моделей Gemma 4 для работы на локальных графических процессорах. Это решение позволяет запускать продвинутый искусственный интеллект прямо на персональных компьютерах и рабочих станциях с видеокартами серии RTX, а также на модулях Jetson Orin Nano и системах DGX Spark.

Главная цель инициативы — перенос вычислительной нагрузки из облака на устройства пользователей, что гарантирует мгновенный доступ к локальному контексту и значительно более быструю работу аналитических алгоритмов.

Семейство моделей Gemma 4 разделено на четыре основных варианта. Версии E2B и E4B разработаны специально для периферийных устройств, позволяя работать в полностью автономном режиме с почти нулевой задержкой. Более мощные модели 26B и 31B предназначены для высокопроизводительных систем. Эти расширенные версии отлично подходят для сложных задач логического вывода, генерации и отладки кода, а также для работы с так называемым агентным ИИ. Программное обеспечение изначально поддерживает мультимодальный ввод данных, позволяя свободно комбинировать текст, изображения, видео и звук в одном запросе. Языковая база включает поддержку более тридцати пяти языков.

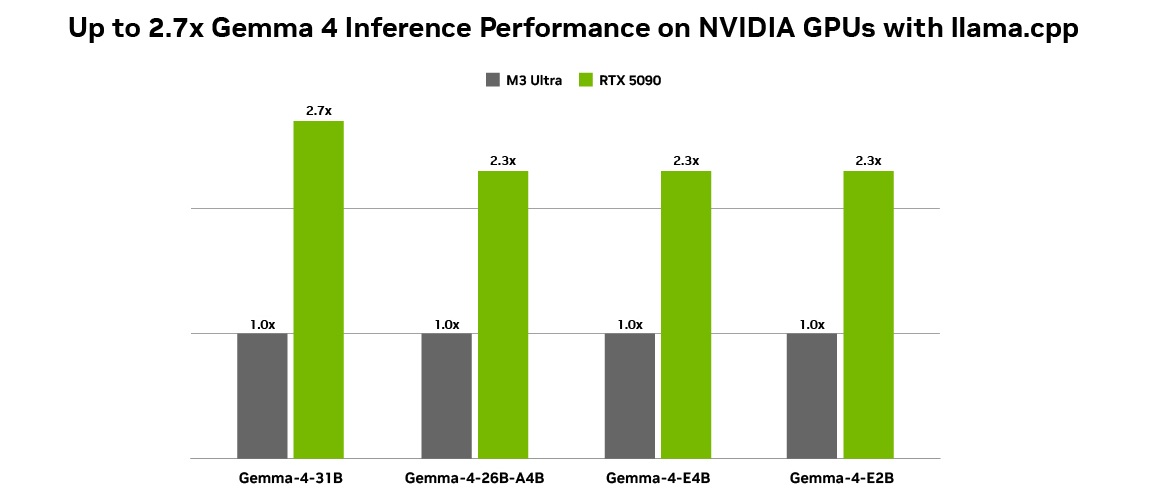

Интеграция с аппаратной архитектурой приносит ощутимые преимущества в производительности. Тензорные ядра, встроенные в графические процессоры NVIDIA, эффективно ускоряют машинный вывод, в то время как среда CUDA обеспечивает полную совместимость с ведущими инструментами разработки уже с момента запуска. Пользователи, заинтересованные во внедрении моделей Gemma 4 на своих компьютерах, могут воспользоваться популярными платформами, такими как Ollama или llama.cpp.

Также обеспечена официальная поддержка программного обеспечения Unsloth Studio, которое позволяет быстро донастраивать и оптимизировать алгоритмы. Новые инструменты полностью совместимы с приложениями вроде OpenClaw, что открывает путь к созданию частных, постоянно активных ассистентов, способных безопасно анализировать личные файлы и автоматизировать повседневную работу.

Этот шаг знаменует важный этап в развитии локального ИИ, делая мощные языковые модели более доступными и независимыми от облачной инфраструктуры. Ранее подобные возможности были прерогативой крупных дата-центров, но теперь они приближаются к рядовому пользователю. Интересно, что конкуренция в этой области нарастает: помимо Google, над локальным запуском больших моделей активно работают Meta с Llama и Microsoft с Phi.

* Meta, Facebook и Instagram запрещены в России.

0 комментариев