Сравнение AI-карт NVIDIA, AMD и Google: преимущество NVIDIA в 5 раз

В обучении и выводе больших AI-моделей видеокарты NVIDIA бесспорно являются наиболее используемыми, в то время как доля AMD, Intel и Google несопоставима. Возникает вопрос: в чем именно заключается превосходство NVIDIA?

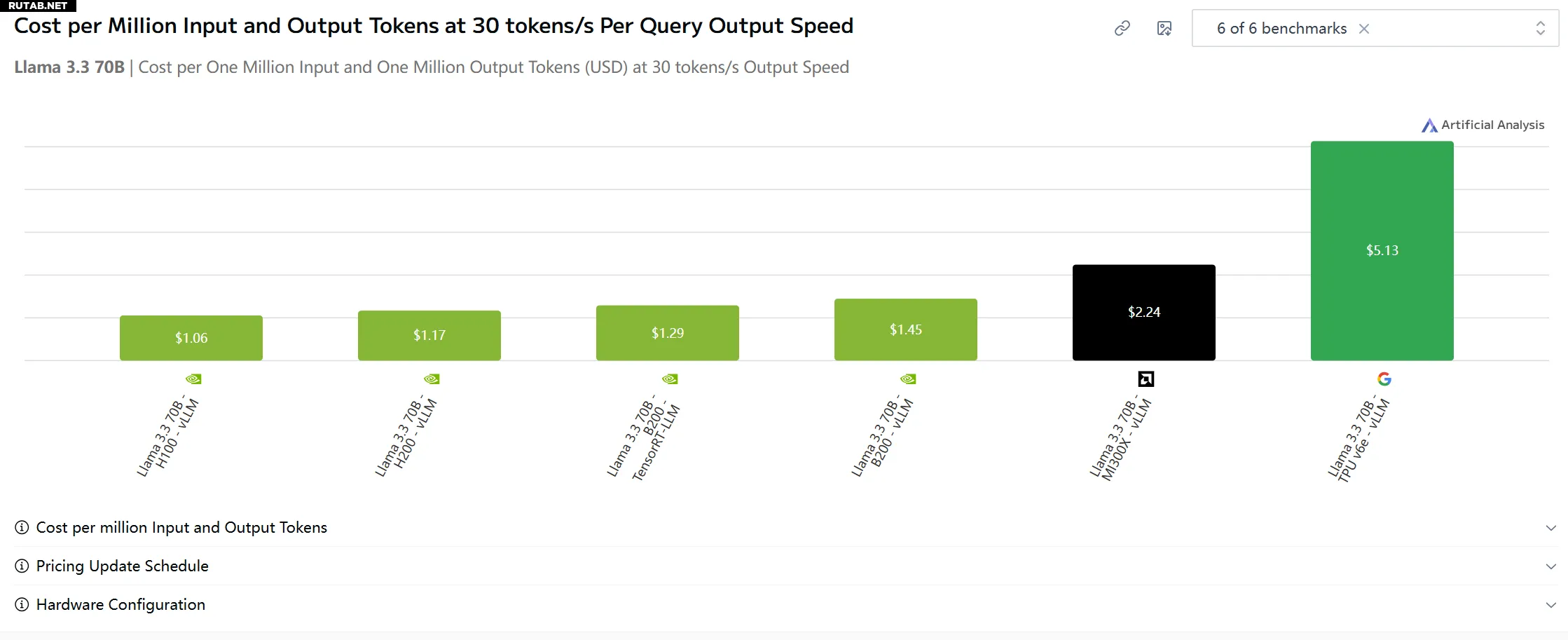

Не говоря уже о преимуществах экосистемы CUDA и параметрах AI-операторов, ресурс Artificial Analysis провел прямое сравнение практической производительности трех основных решений для вывода, используя Google TPU v6e, AMD MI300X и NVIDIA H100/B200.

Тестов было много, но достаточно взглянуть на сводный показатель — стоимость миллиона входных/выходных токенов при скорости 30 токенов в секунду на модели Llama 3.3 70B.

В этом аспекте стоимость H100 составляет 1,06 доллара, H200 — всего 1,17 доллара, B200 TensorRT — 1,23 доллара, B200 — 1,45 доллара, AMD MI300X — 2,24 доллара, а Google TPU v6e — 5,13 доллара.

Таким образом, видеокарты NVIDIA имеют как минимум двукратное преимущество в производительности к стоимости по сравнению с AMD и примерно пятикратное преимущество по сравнению с Google — разница весьма значительна.

Даже с использованием новейших и самых дорогих видеокарт NVIDIA B200 рост затрат не слишком заметен, учитывая существенный прирост производительности, который по-прежнему дает большое преимущество над решениями AMD и Google.

На данный момент можно сказать, что текущие AI-карты AMD и Google значительно уступают, но следующее поколение продуктов обещает резкий рост: серия AMD MI400X будет оснащена до 432 ГБ памяти HBM4, а Google TPU v7, как сообщается, получит многократное увеличение производительности, что может изменить результаты этого тестирования.

Разумеется, NVIDIA не будет сидеть сложа руки — уже анонсировано следующее поколение карт Rubin, которые поступят в продажу в следующем году и, вероятно, еще больше увеличат отрыв.

0 комментариев