NVIDIA Blackwell занимает лидирующие позиции в последних результатах MLPerf Inference

Блэкуэлл, Блэквелл (англ. Blackwell) — английская фамилия. Википедия

Читайте также:NVIDIA добавляет ускорение цвета видео 4:2:2 в Adobe Premiere Pro с GeForce BlackwellNVIDIA хочет прозрачности TDP для GeForce RTX 50RTX Pro 6000 Blackwell стоит $8565Варианты Nvidia RTX Pro 6000: Blackwell, Max-Q и ServerNvidia представляет рабочие станции DGX Station с процессором GB300 Blackwell Ultra внутри

Иску́сственный интелле́кт (ИИ; англ. artificial intelligence, AI) — свойство искусственных интеллектуальных систем выполнять творческие функции, которые традиционно считаются прерогативой человека (не следует путать с искусственным сознанием); наука и технология создания интеллектуальных машин, особенно интеллектуальных компьютерных программ.

Искусственный интеллект связан со сходной задачей использования компьютеров для понимания человеческого интеллекта, но не обязательно ограничивается биологически правдоподобными методами.

Существующие на сегодня интеллектуальные системы имеют довольно узкие области применения. Википедия

Иску́сственный интелле́кт (ИИ; англ. artificial intelligence, AI) — свойство искусственных интеллектуальных систем выполнять творческие функции, которые традиционно считаются прерогативой человека (не следует путать с искусственным сознанием); наука и технология создания интеллектуальных машин, особенно интеллектуальных компьютерных программ.

Искусственный интеллект связан со сходной задачей использования компьютеров для понимания человеческого интеллекта, но не обязательно ограничивается биологически правдоподобными методами.

Существующие на сегодня интеллектуальные системы имеют довольно узкие области применения. Википедия

Читайте также:Lightmatter создала суперчип с фотонным ИИ-соединениемAyar Labs представляет первый в мире оптический чипсет UCIe для масштабируемых архитектур ИИКрах китайских центров обработки данных ИИTachyum показала DRAM для ИИ на Prodigy FPGA«Ведьмак»: CDPR не применяет генеративный ИИ

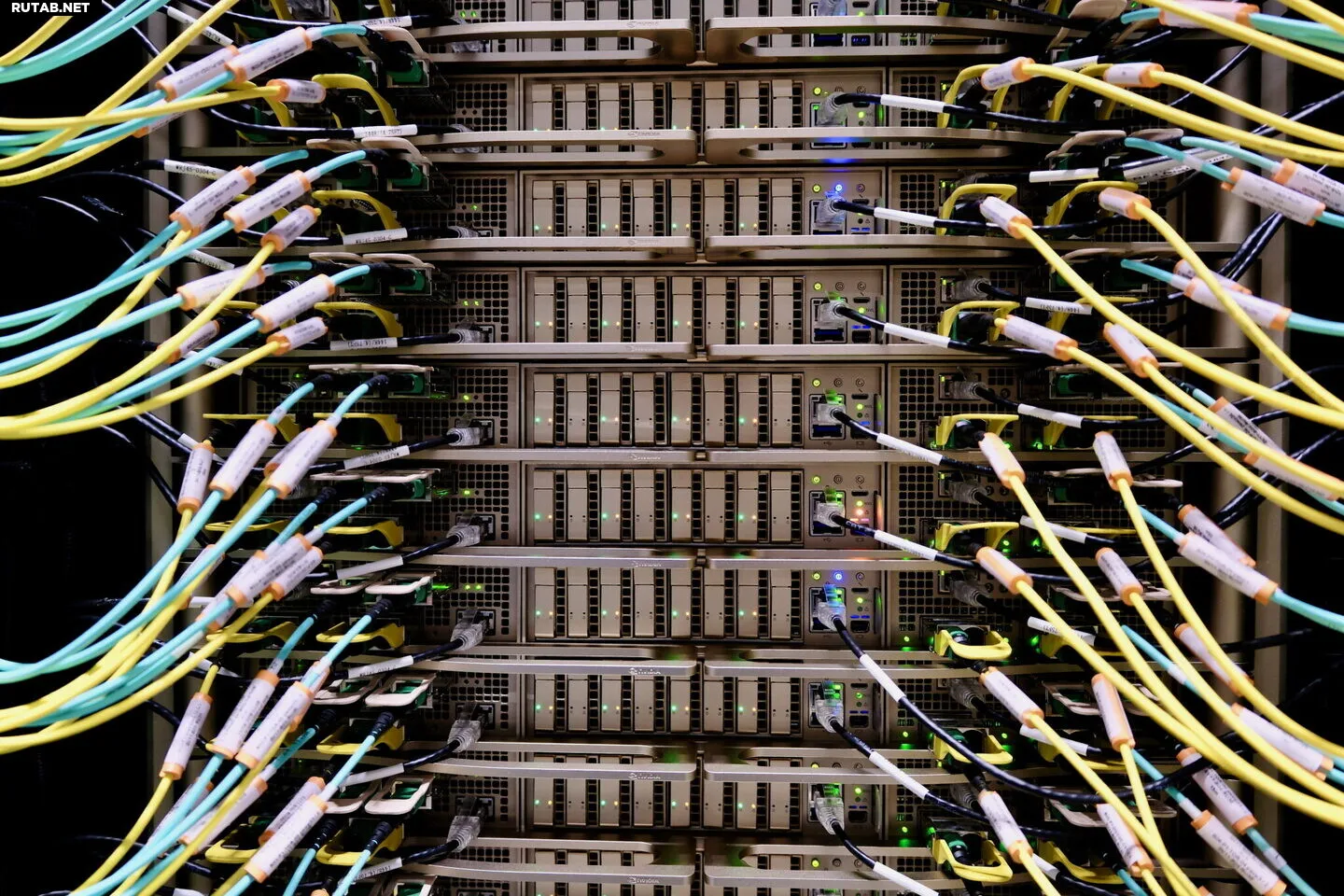

Сложность выполнения этого значительна и происходит за кулисами. По мере того, как модели ИИ разрастаются до миллиардов и триллионов параметров для предоставления более умных ответов, вычисления, необходимые для генерации каждого токена, увеличиваются. Это требование уменьшает количество токенов, которые может генерировать фабрика ИИ, и увеличивает стоимость за токен. Поддержание высокой пропускной способности вывода и низкой стоимости за токен требует быстрых инноваций на каждом уровне технологического стека, охватывающего кремний, сетевые системы и программное обеспечение.

Последние обновления MLPerf Inference, рецензируемого отраслевого бенчмарка производительности вывода, включают добавление Llama 3.1 405B, одной из самых больших и сложных для запуска моделей open-weight. Новый интерактивный бенчмарк Llama 2 70B имеет гораздо более строгие требования к задержке по сравнению с исходным бенчмарком Llama 2 70B, лучше отражая ограничения производственных развертываний для предоставления наилучшего пользовательского опыта.

Помимо платформы Blackwell, исключительную производительность по всем направлениям продемонстрировала платформа NVIDIA Hopper, при этом производительность Llama 2 70B значительно возросла за последний год благодаря оптимизации всего стека.

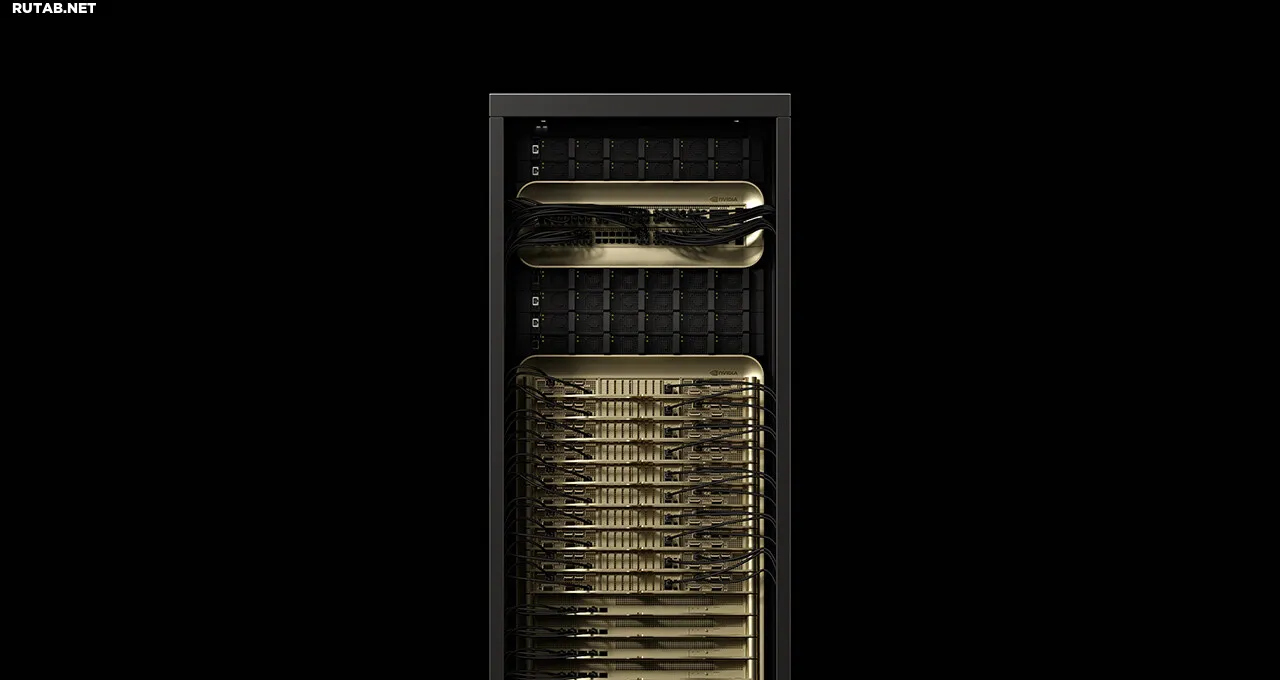

NVIDIA Blackwell устанавливает новые рекорды

Система GB200 NVL72, объединяющая 72 графических процессора NVIDIA Blackwell для работы в качестве одного массивного графического процессора, обеспечила в 30 раз большую пропускную способность на тесте Llama 3.1 405B по сравнению с NVIDIA H200 NVL8, представленной в этом раунде. Этот подвиг был достигнут за счет более чем утроенной производительности на графический процессор и в 9 раз большего домена межсоединений NVIDIA NVLink.

В то время как многие компании запускают тесты MLPerf на своем оборудовании для оценки производительности, только NVIDIA и ее партнеры представили и опубликовали результаты теста Llama 3.1 405B.

Развертывания производственного вывода часто имеют ограничения по задержке по двум ключевым метрикам. Первый — это время до первого токена (TTFT), или сколько времени требуется пользователю, чтобы начать видеть ответ на запрос, заданный большой языковой модели. Второй — это время на выходной токен (TPOT), или как быстро токены доставляются пользователю.

Новый интерактивный бенчмарк Llama 2 70B имеет в 5 раз более короткий TPOT и в 4,4 раза более низкий TTFT, моделируя более отзывчивый пользовательский опыт. В этом тесте заявка NVIDIA с использованием системы NVIDIA DGX B200 с восемью графическими процессорами Blackwell утроила производительность по сравнению с использованием восьми графических процессоров NVIDIA H200, установив высокую планку для этой более сложной версии бенчмарка Llama 2 70B.

Сочетание архитектуры Blackwell и ее оптимизированного программного стека обеспечивает новый уровень производительности вывода, открывая путь для фабрик искусственного интеллекта, которые смогут обеспечить более высокий уровень интеллекта, увеличенную пропускную способность и более высокую скорость обработки токенов.

Стоимость фабрики NVIDIA Hopper AI продолжает расти

Архитектура NVIDIA Hopper, представленная в 2022 году, обеспечивает работу многих современных фабрик вывода ИИ и продолжает обеспечивать обучение моделей. Благодаря постоянной оптимизации программного обеспечения NVIDIA увеличивает производительность фабрик ИИ на базе Hopper, что приводит к повышению ценности.

На бенчмарке Llama 2 70B, впервые представленном год назад в MLPerf Inference v4.0, пропускная способность H100 GPU увеличилась в 1,5 раза. H200 GPU, основанный на той же архитектуре Hopper GPU с большей и более быстрой памятью GPU, расширяет это увеличение до 1,6 раза.

Hopper также выполнил все бенчмарки, включая недавно добавленные Llama 3.1 405B, Llama 2 70B Interactive и графовые тесты нейронной сети. Эта универсальность означает, что Hopper может выполнять широкий спектр рабочих нагрузок и идти в ногу со временем, когда модели и сценарии использования становятся все более сложными.

Нужна экосистема

В этом раунде MLPerf 15 партнеров представили выдающиеся результаты на платформе NVIDIA, среди которых ASUS, Cisco, CoreWeave, Dell Technologies, Fujitsu, Giga Computing, Google Cloud, Hewlett Packard Enterprise, Lambda, Lenovo, Oracle Cloud Infrastructure, Quanta Cloud Technology, Supermicro, Sustainable Metal Cloud и VMware.

Разнообразие заявок отражает охват платформы NVIDIA, которая доступна всем поставщикам облачных услуг и производителям серверов по всему миру.

Работа MLCommons по постоянному совершенствованию набора тестов MLPerf Inference для соответствия новейшим разработкам в области ИИ и предоставления экосистеме точных, проверенных экспертами данных о производительности имеет решающее значение для оказания помощи лицам, принимающим решения в области ИТ, в выборе оптимальной инфраструктуры ИИ.

Источник: NVIDIA

0 комментариев