GPT-4V плохо играет в Doom... пока

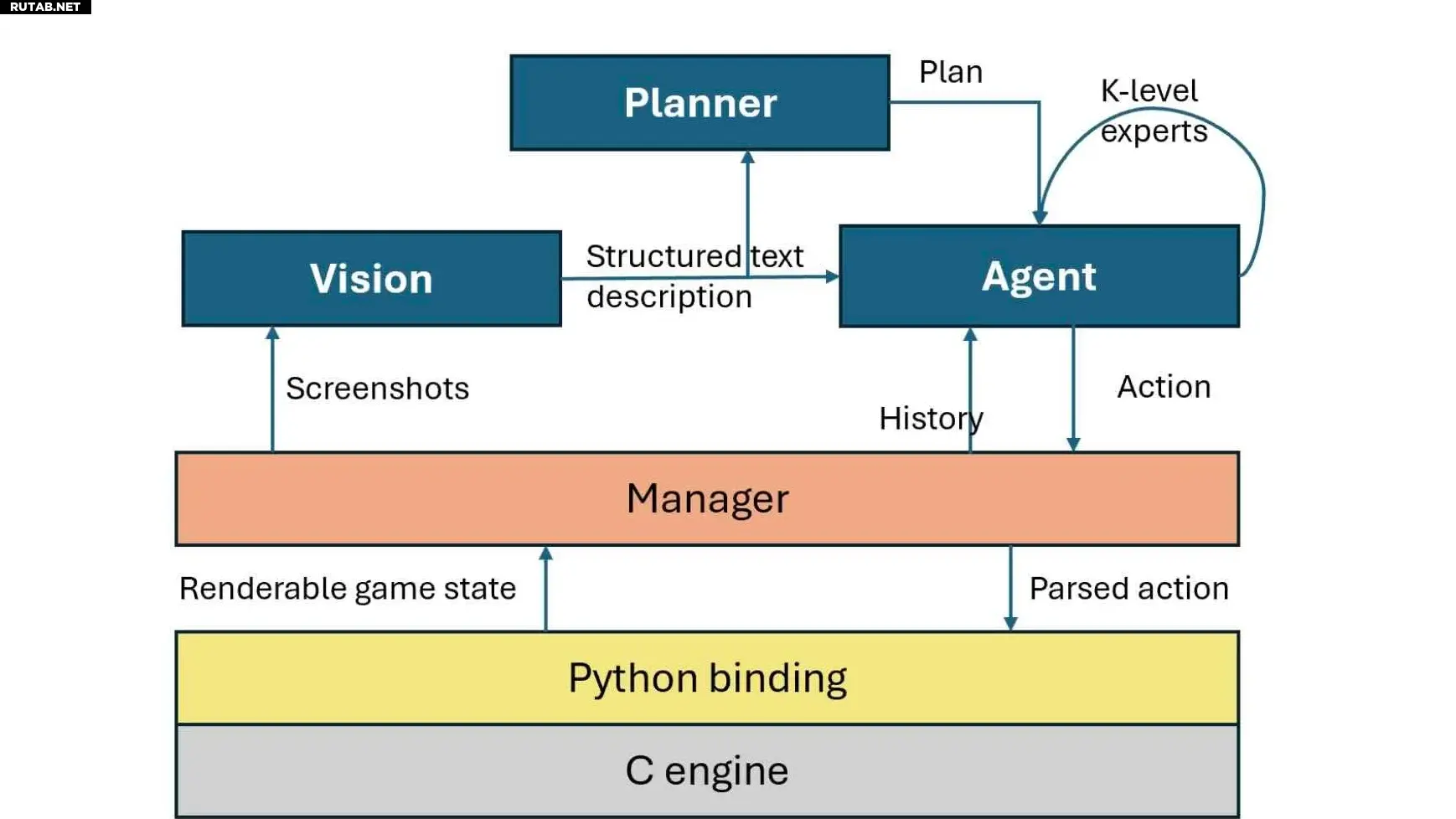

Сотрудник Microsoft и исследователь из Йоркского университета Адриан де Винтер недавно решил протестировать GPT-4, запустив шутер Doom без предварительной подготовки, сообщает The Register. Результаты показывают, что GPT-4 может играть в Doom с некоторой степенью эффективности без предварительного обучения, хотя для настройки требуется интерфейс GPT-4V для видения ИИ и добавление Matplotlib и Python, чтобы сделать возможным ввод данных ИИ.

Согласно оригинальной статье, ИИ GPT-4, играющий в Doom, может открывать двери, сражаться с врагами и стрелять из оружия. Базовые функциональные возможности игрового процесса, включая навигацию по миру, есть практически все. Однако у ИИ нет чувства постоянства объекта — как только враг оказывается за кадром, ИИ вообще о нем больше не подозревает. Несмотря на то, что включены инструкции о том, что делать, если враг за кадром наносит ущерб, модель не может реагировать ни на что, выходящее за рамки ее узкой области действия.

Говоря об этических выводах своего исследования, Де Винтер отмечает: «Довольно тревожно, насколько легко мне было написать код, позволяющий модели довольно точно стрелять».

Он продолжает: «Итак, хотя это очень интересное исследование планирования и рассуждения, которое может найти применение в автоматизированном тестировании видеоигр, совершенно очевидно, что эта модель не осознает, что она делает. Я настоятельно призываю всех задуматься о том, что внедрение этих моделей означает для общества и их потенциальное неправильное использование».

Конечно, он не ошибается: передовые технологии становятся все умнее с каждым годом. Еще в 90-х годах суперкомпьютер Deep Blue от IBM одержал победу над гроссмейстером по шахматам Гарри Каспаровым. Теперь у нас есть GPT-4V, который с минимальными усилиями со стороны одного человека способен начать отстрел монстров в Doom. Представьте себе, что можно было бы сделать, если бы за такой работой стояли военные.

К счастью, люди еще не научились производить ботов-убийц, обладающих меткостью и мышлением наравне с лучшими игроками, не говоря уже о непреодолимой силе среднего Т-800. На данный момент основная «атака на человечество» со стороны ИИ происходит на трудовом фронте.

Но тот факт, что GPT-4 без колебаний стрелял в объекты в форме людей, конечно, может вызывать некоторое беспокойство. Сейчас самое время напомнить читателям, что «Законы робототехники» Айзека Азимова, запрещающие роботам причинять вред людям, всегда были вымыслом. Надеемся, что специалисты, занимающиеся проектами искусственного интеллекта, смогут найти способы укоренить защиту человечества в своих моделях до того, как Скайнет выйдет в сеть.

0 комментариев