Osaurus — открытая ИИ-платформа для Mac, объединяющая локальные и облачные модели

Стартапы активно создают программную прослойку для работы с ИИ-моделями, которые становятся всё более доступными. Один из новых игроков в этой сфере — Osaurus, открытый LLM-сервер, предназначенный исключительно для Mac. Платформа позволяет пользователям переключаться между различными локальными и облачными ИИ-моделями, сохраняя все файлы и инструменты на собственном устройстве.

Osaurus появился из идеи настольного ИИ-компаньона Dinoki, который сооснователь проекта Теренс Пэ описывал как «Clippy на базе ИИ». Клиенты Dinoki задавались вопросом, зачем покупать приложение, если всё равно приходится платить за токены. Это подтолкнуло Пэ к идее запуска ИИ локально.

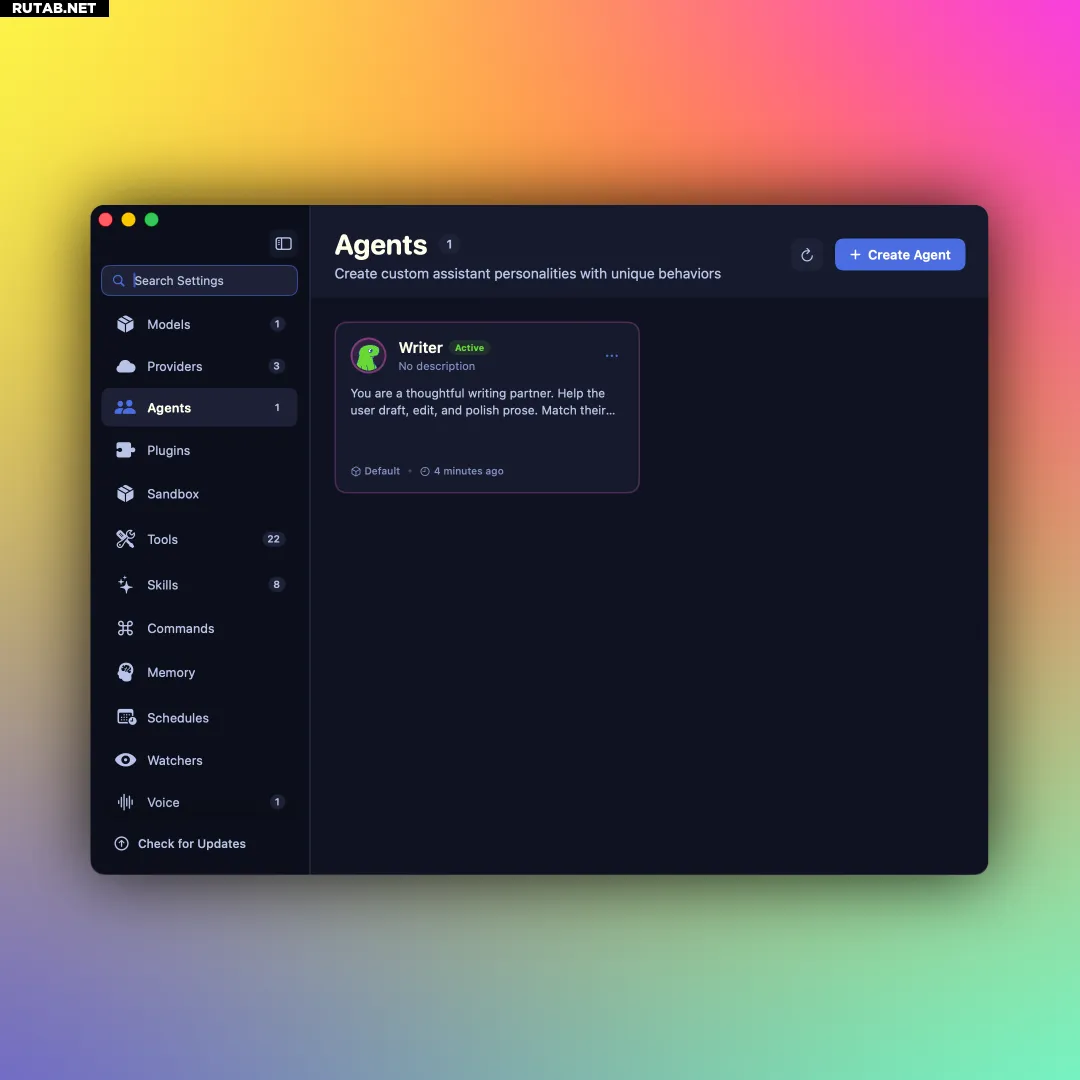

«Так и начался Osaurus, — рассказал Пэ, ранее работавший инженером в Tesla и Netflix. — Идея заключалась в том, чтобы запустить ИИ-ассистента локально. На Mac можно делать практически всё: просматривать файлы, работать с браузером, менять системные настройки. Я решил, что это отличный способ позиционировать Osaurus как персональный ИИ для каждого пользователя».

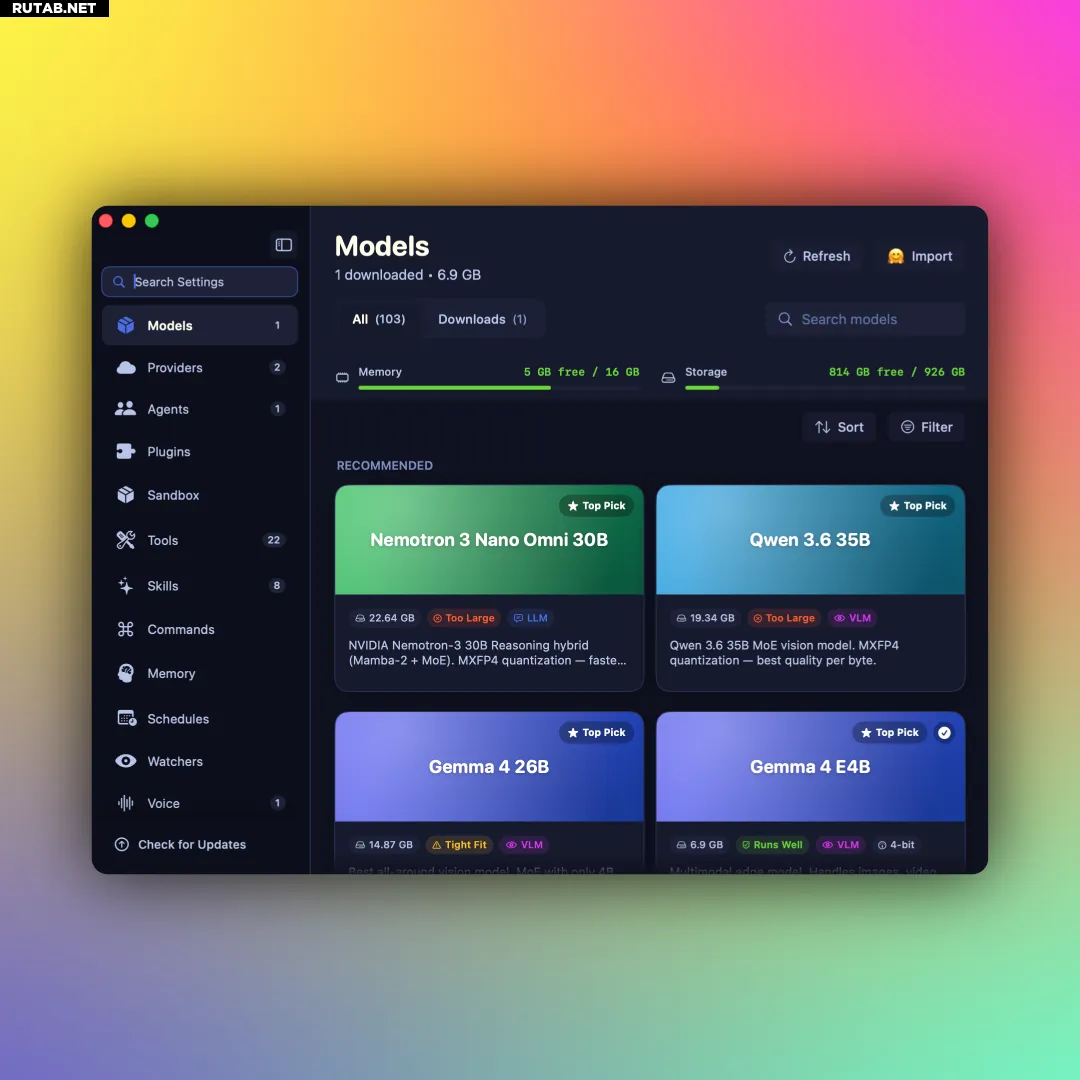

Сегодня Osaurus гибко подключается как к локальным ИИ-моделям, так и к облачным провайдерам, включая OpenAI и Anthropic. Пользователи могут свободно выбирать используемые модели, оставляя на своём устройстве память моделей, файлы и инструменты. Поскольку разные модели обладают разными сильными сторонами, система позволяет переключаться на наиболее подходящую для конкретной задачи.

Такая структура делает Osaurus «обвязкой» — управляющим слоем, объединяющим различные ИИ-модели, инструменты и рабочие процессы через единый интерфейс, подобно OpenClaw или Hermes. Однако эти инструменты часто ориентированы на разработчиков, знакомых с терминалом, и могут иметь проблемы с безопасностью. Osaurus же предлагает простой интерфейс для обычных пользователей и решает вопросы безопасности, запуская всё в аппаратно-изолированной виртуальной песочнице, что ограничивает действия ИИ и защищает компьютер и данные.

Запуск ИИ-моделей на собственном устройстве пока находится на ранней стадии, так как требует значительных ресурсов. Для локальных моделей потребуется минимум 64 ГБ оперативной памяти, а для больших моделей, таких как DeepSeek v4, Пэ рекомендует около 128 ГБ ОЗУ. Однако он считает, что со временем требования снизятся.

«Я вижу потенциал, потому что „интеллект на ватт" — метрика для локального ИИ — значительно растёт. Это собственная кривая инноваций. В прошлом году локальный ИИ едва мог закончить предложения, а сегодня он уже запускает инструменты, пишет код, работает с браузером и заказывает товары на Amazon... Он становится всё лучше и лучше», — отметил Пэ.

Osaurus поддерживает MiniMax M2.5, Gemma 4, Qwen3.6, GPT-OSS, Llama, DeepSeek V4 и другие модели, а также базовые модели Apple на устройстве и семейство LFM от Liquid AI. В облаке платформа подключается к OpenAI, Anthropic, Gemini, xAI/Grok, Venice AI, OpenRouter, Ollama и LM Studio. Как полноценный MCP-сервер, он предоставляет доступ к инструментам любому MCP-совместимому клиенту и поставляется с более чем 20 встроенными плагинами для Mail, Calendar, Vision, macOS Use, XLSX, PPTX, Browser, Music, Git, Filesystem, Search и Fetch. Недавно в Osaurus также появились голосовые возможности.

С момента запуска около года назад приложение скачали более 112 000 раз. Osaurus конкурирует с такими инструментами, как Ollama, Msty и LM Studio, но предлагает более широкий набор функций и позиционируется как более удобный вариант для не-разработчиков.

В настоящее время основатели Osaurus (включая сооснователя Сэма Ю) участвуют в нью-йоркском стартап-акселераторе Alliance. Они рассматривают возможность предложения платформы бизнесу, например, в юридической сфере или здравоохранении, где запуск локальных LLM может решить вопросы конфиденциальности. По мере роста мощности локальных ИИ-моделей команда считает, что это может снизить спрос на центры обработки данных.

«Мы наблюдаем взрывной рост в сфере ИИ, где облачные провайдеры вынуждены масштабироваться с помощью дата-центров и инфраструктуры, но мы считаем, что люди ещё не осознали ценность локального ИИ, — сказал Пэ. — Вместо того чтобы полагаться на облако, можно развернуть Mac Studio локально, и это будет потреблять значительно меньше энергии. У вас останутся возможности облака, но вы не будете зависеть от дата-центра для работы ИИ».

0 комментариев