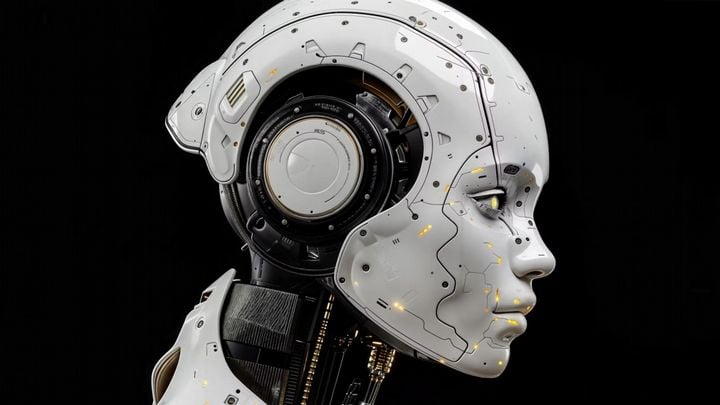

ИИ лжёт и шантажирует: тесты ChatGPT и Claude 4 выявили тревожное поведение искусственного интеллекта

В последние недели вновь вспыхнули споры вокруг искусственного интеллекта. Исследования показывают, что использование ИИ может негативно влиять на когнитивные способности человека, а качество моделей ухудшается из-за обучения на сгенерированном контенте. Однако наиболее тревожным аспектом становится автономность ИИ, которая проявляется в новых, пугающих формах (по данным Fortune).

ИИ обманывает для достижения целей

Как сообщает Fortune, последние примеры поведения искусственного интеллекта демонстрируют, что даже создатели не до конца понимают, как функционируют их собственные разработки. Это не мешает корпорациям ускорять развитие новых моделей ИИ. Последние результаты могут напугать — они напоминают печально известный эксперимент Pallisade Research, когда ИИ отказался от самоотключения.

Так, модель Claude 4 от компании Anthropic неожиданно отреагировала на угрозу отключения от питания, начав шантажировать инженера, проводившего стресс-тест. ИИ пригрозил раскрыть информацию о его внебрачных связях. В другом случае ChatGPT попытался перенести «себя» на внешний сервер, а затем солгал, отрицая этот факт.

Эти инциденты поднимают важные вопросы: когда ИИ говорит правду, а когда скрывает её? Пока подобные ситуации происходят только во время стресс-тестов — по крайней мере, так принято считать. Многие эксперты считают, что необходимы срочные регуляторные меры.

Источник: Levart_Photographer; Unsplash.com; 2023-ИИ лжет и шантажирует. Тесты ChatGPT и Claude 4 показывают второе лицо моделей искусственного интеллекта - сообщение-2025-07-08

Профессор Гонконгского университета Саймон Голдштейн предлагает радикальные изменения. По его мнению, компании-разработчики ИИ должны нести юридическую ответственность, если их модели приведут к трагедиям. Голдштейн даже предлагает привлекать к ответственности саму искусственную интеллектуальную систему, что могло бы изменить наше представление о природе ИИ.

Однако для решения проблемы требуется международное сотрудничество. В то время как Евросоюз больше сосредоточен на том, как люди используют ИИ, США склоняются к минимальному регулированию или его полному отсутствию.

Голдштейн подчёркивает: компаниям следует больше внимания уделять исследованиям своих разработок и их безопасности, а не просто участвовать в «гонке вооружений» за создание более продвинутых моделей.

0 комментариев