Pliops ускоряет ИИ-инференс с помощью 3D NAND-акселератора — до 8 раз быстрее

Компания Pliops представила решение для ускорения работы языковых моделей ИИ, позволяющее увеличить скорость обработки данных до 8 раз. Технология основана на использовании 3D NAND-памяти и специального акселератора XDP LightningAI.

Проблема современных ИИ-систем заключается в ограниченном объеме высокоскоростной памяти (HBM) графических процессоров. Когда контекст модели превышает доступную память, система вынуждена пересчитывать данные, что увеличивает задержки и нагрузку на GPU. Pliops предлагает хранить предварительно вычисленный контекст на быстрых SSD и мгновенно извлекать его при необходимости.

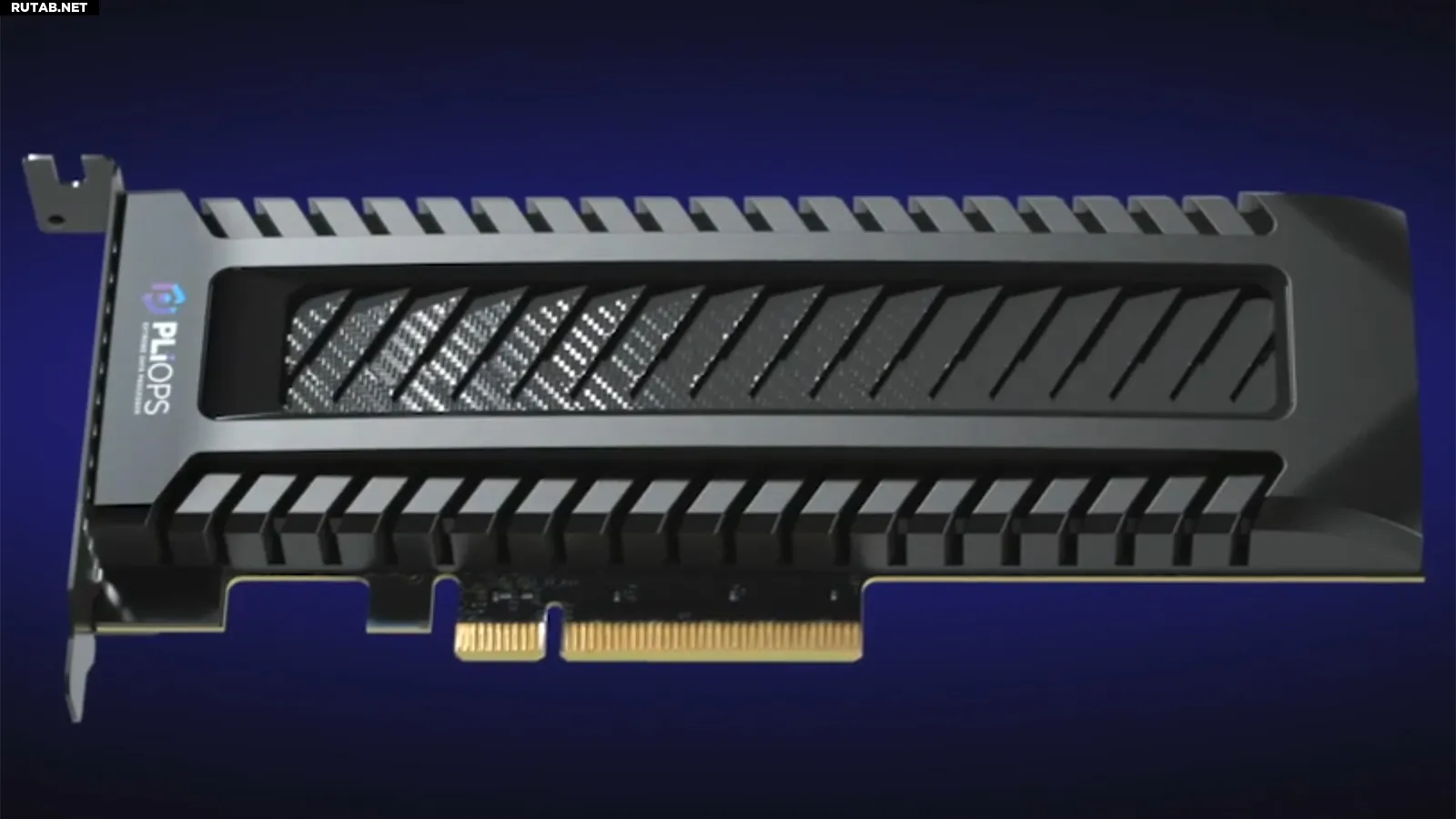

Изображение: Pliops

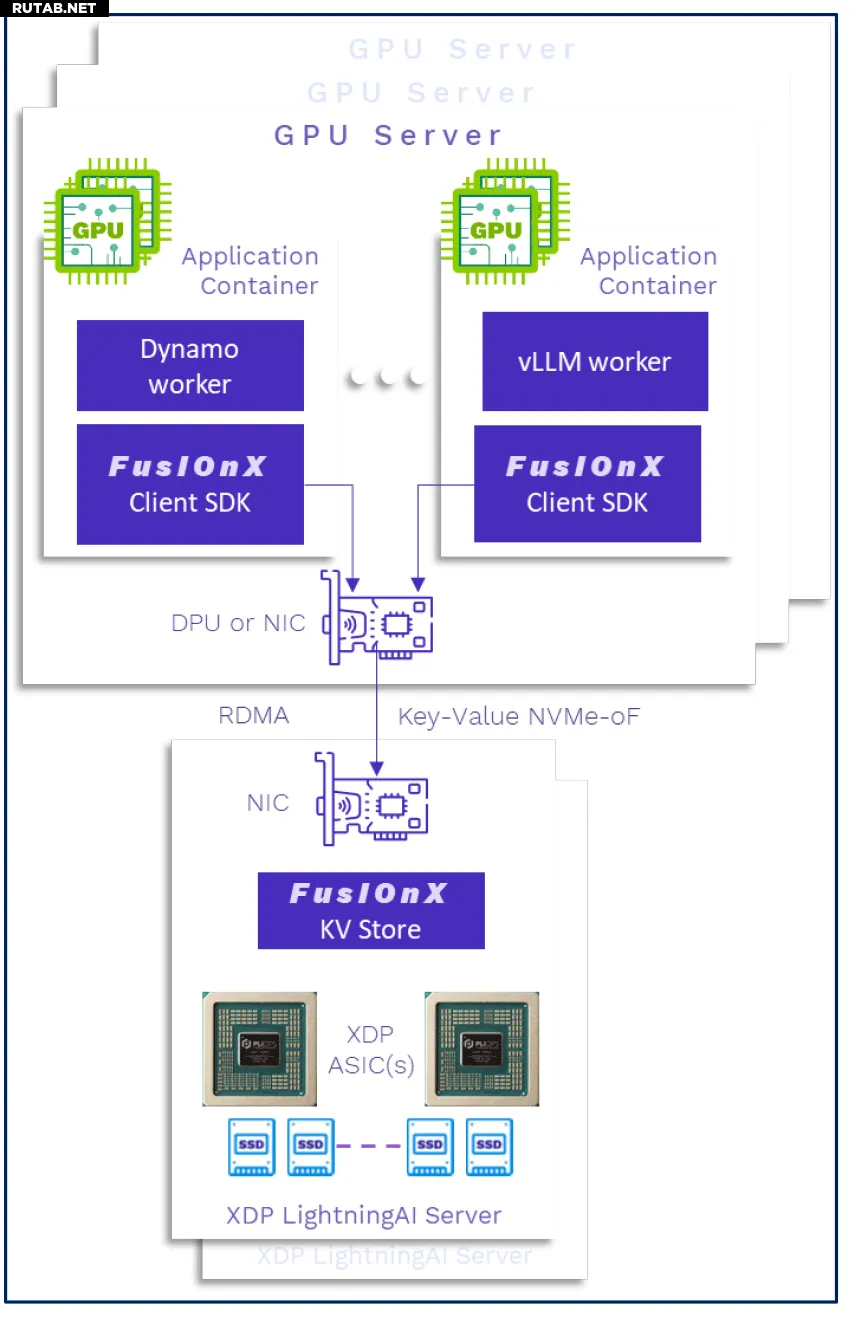

Решение включает в себя:

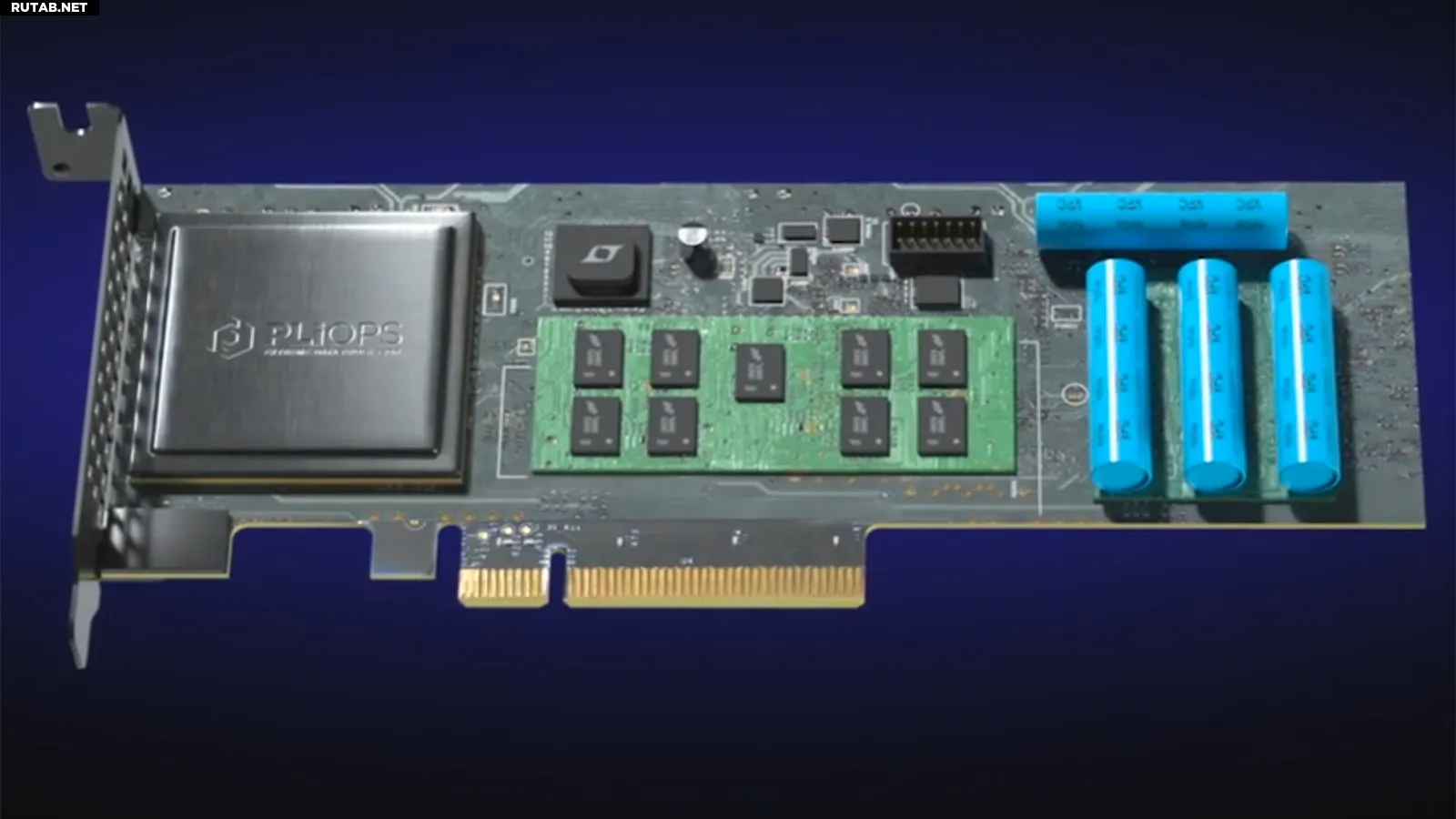

- PCIe-устройство XDP LightningAI с собственным ASIC-чипом

- Программное обеспечение FusIOnX для управления данными

- Поддержку фреймворков vLLM и Nvidia Dynamo

- Совместимость с любыми GPU и многопроцессорными системами

Хотя пропускная способность SSD (336 ГБ/с) уступает HBM (3,35 ТБ/с), отсутствие необходимости пересчета данных обеспечивает значительный прирост производительности. По заявлениям Pliops, их решение увеличивает пропускную способность типичной системы vLLM в 2,5-8 раз без необходимости наращивания GPU.

Изображение: Pliops

ИИ: Интересное решение, которое может снизить стоимость инфраструктуры для ИИ, особенно для крупных языковых моделей. Вместо дорогостоящего наращивания GPU-памяти компания предлагает более экономичную альтернативу с минимальными потерями в производительности.

Источник: Tomshardware.com

0 комментариев