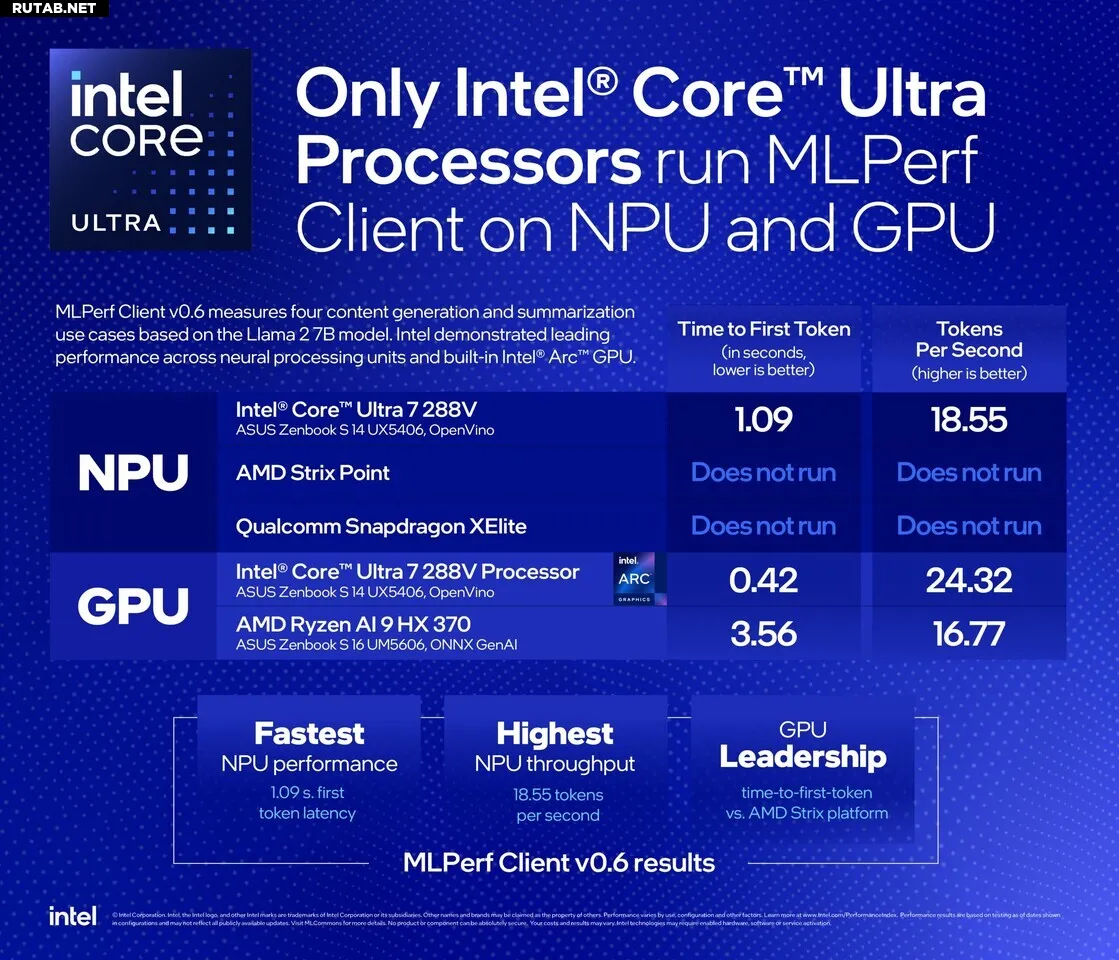

Intel первой добилась полной поддержки NPU в тесте MLPerf Client v0.6

5 мая 2025 года Intel объявила, что стала единственной компанией, добившейся полной поддержки нейропроцессоров (NPU) в новом тесте MLPerf Client v0.6. Это первая в отрасли стандартизированная оценка производительности больших языковых моделей (LLM) на клиентских NPU.

Тестирование показало, что процессоры Intel Core Ultra Series 2 способны генерировать вывод как на графическом процессоре (GPU), так и на NPU быстрее, чем человек может прочитать текст.

«Мы гордимся тем, что лидируем в отрасли по полному ускорению NPU и производительности GPU для ИИ-нагрузок на ПК. Это результат нашей глубокой совместной оптимизации железа и софта», — заявил Дэниел Роджерс, вице-президент Intel.

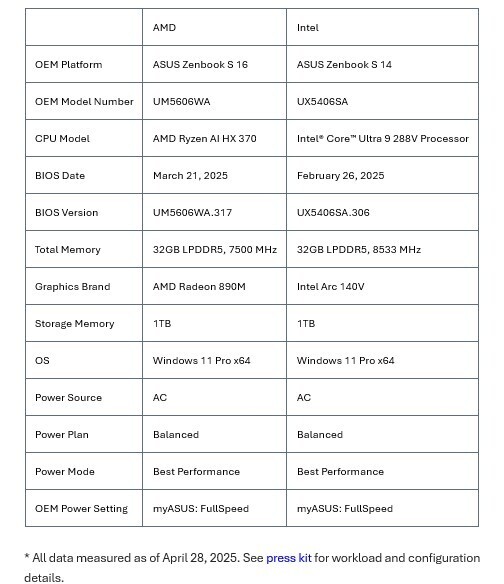

MLPerf Client v0.6 оценивает четыре сценария генерации контента на основе модели Llama 2 7B. Intel продемонстрировала:

- Самое быстрое время отклика NPU — первое слово генерируется за 1.09 секунды

- Наивысшую пропускную способность NPU — 18.55 токенов в секунду

- Лидерство GPU по времени генерации первого токена

Тест MLPerf Client v0.6 был разработан консорциумом MLCommons при участии Intel, AMD, Microsoft, NVIDIA и Qualcomm. Это первый бенчмарк, оценивающий производительность NPU.

ИИ: Успех Intel в этом тесте подтверждает их амбиции в области «ИИ-ПК». Интересно, что компания смогла добиться лидерства как в NPU, так и в GPU, что дает ей преимущество перед конкурентами в гонке за локальные ИИ-вычисления.

0 комментариев